在数字内容创作领域,面部视频生成技术一直是研究热点。字节跳动最新发布的X-Portrait2技术,以其卓越的表现力和自然生动的效果,成为行业关注的焦点。这项技术不仅在面部和唇部肌肉表现上优于Runway和HeyGen等竞争对手,还通过创新的模型设计和训练框架,实现了跨ID、跨风格的动作迁移。

技术核心:表情编码器与自监督训练

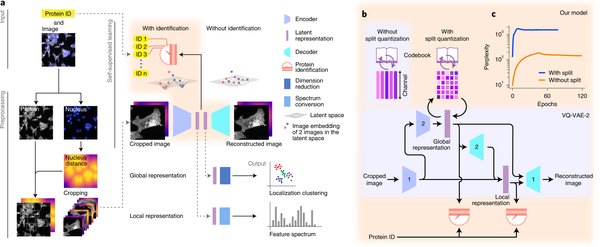

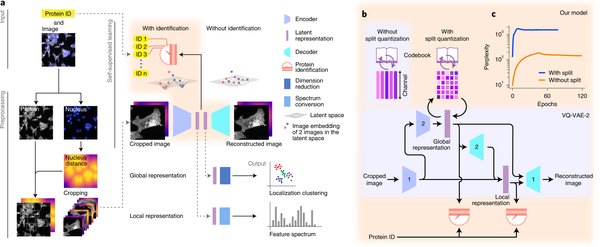

X-Portrait2的核心在于其先进的表情编码器模型和自监督训练框架。表情编码器能够精准捕捉面部细微变化,并将其转化为可迁移的动作数据。自监督训练框架则通过大量无标签数据的学习,提升了模型的泛化能力,使其能够适应不同风格和ID的面部特征。

跨ID、跨风格的动作迁移

X-Portrait2的一大亮点是其跨ID、跨风格的动作迁移能力。这意味着,用户可以将一个ID的面部动作无缝迁移到另一个ID上,同时保持动作的自然性和风格的统一性。这种能力为数字内容创作提供了更多可能性,例如在影视制作、虚拟偶像等领域实现更高效、更真实的效果。

应用场景与未来展望

X-Portrait2技术的应用场景广泛,包括但不限于:

-

影视制作:快速生成角色面部表情,提升制作效率。

-

虚拟偶像:为虚拟人物赋予更生动的面部表现。

-

教育培训:通过面部视频生成技术,创建互动式教学内容。

未来,随着技术的进一步优化和普及,X-Portrait2有望在更多领域发挥其价值,推动数字内容创作的创新与发展。

总结

字节跳动的X-Portrait2技术以其卓越的性能和广泛的应用前景,为面部视频生成领域带来了突破性进展。通过先进的表情编码器模型和自监督训练框架,X-Portrait2不仅实现了跨ID、跨风格的动作迁移,还为用户提供了更自然、更生动的面部表现。这一技术的发布,标志着数字内容创作迈向了一个新的高度。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...