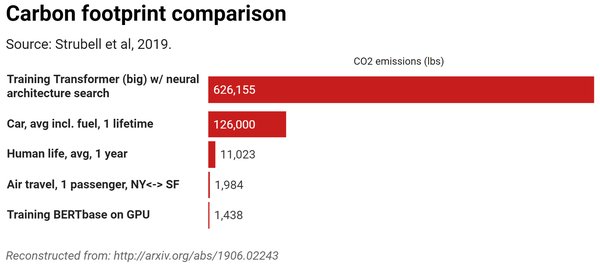

在人工智能领域,神经网络的应用已经取得了令人瞩目的成就,但其高昂的能耗成本也成为了不可忽视的挑战。传统神经网络依赖于大量的计算资源,尤其是在图形处理器(GPU)上运行时,能耗问题尤为突出。然而,在2024年的神经信息处理系统大会(NeurIPS)上,斯坦福大学的博士后菲利克斯·彼得森展示了一种全新的解决方案——逻辑门网络,这一技术有望彻底改变人工智能的能耗格局。

什么是逻辑门网络?

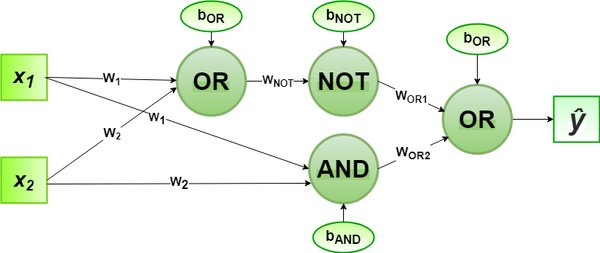

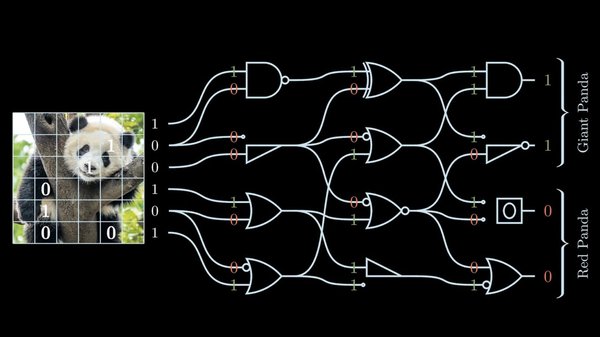

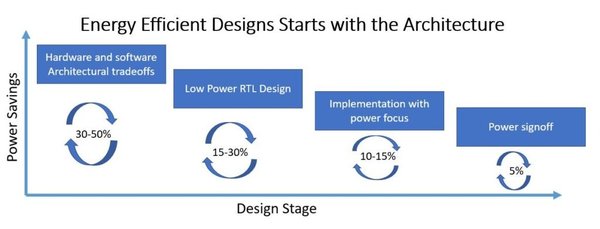

逻辑门网络是一种由逻辑门组成的神经网络,逻辑门是计算机芯片的基本构建模块,由晶体管组成,能够接受二进制输入并输出结果。与传统神经网络不同,逻辑门网络直接嵌入硬件中,省去了将网络转换为硬件语言的中间步骤,从而大幅降低了能耗和时间成本。

彼得森的设计灵感来源于“可微分松弛”技术,这是一种将数学问题转化为微积分可解形式的方法。通过创建能够输出中间值的逻辑门函数,彼得森成功实现了逻辑门网络的反向传播训练,这是深度学习革命的核心技术之一。

逻辑门网络的优势

-

能耗极低:相比传统神经网络,逻辑门网络在能耗方面表现出色。在CIFAR-10数据集的测试中,逻辑门网络仅需传统神经网络十分之一的逻辑门数量,并在不到千分之一的时间内完成任务。

-

硬件集成:逻辑门网络可以直接嵌入计算机芯片中,未来有望应用于智能手机和其他移动设备,减少与服务器之间的数据传输需求。

-

成本效益:尽管训练逻辑门网络需要更多时间和资源,但一旦训练完成,其运行成本将显著降低。

挑战与争议

尽管逻辑门网络在能耗和效率方面表现优异,但其应用前景仍存在争议。美国加州大学圣地亚哥分校的教授法里纳兹·库尚法尔指出,逻辑门网络只能通过近似训练实现,随着网络规模的扩大,这种近似可能会失效。此外,逻辑门网络在图像标记等任务上的表现仍不如传统神经网络。

未来展望

彼得森对逻辑门网络的未来充满信心。他计划继续改进这一技术,目标是创建一个“硬件基础模型”,能够在芯片上实现大规模应用。如果成功,逻辑门网络将为人工智能领域带来巨大的能源效益,并推动深度学习技术在资源有限环境中的普及。

逻辑门网络的出现,不仅是人工智能技术的一次重要突破,更是对可持续计算的一次深刻探索。随着技术的不断成熟,我们有理由相信,逻辑门网络将成为未来人工智能发展的重要方向之一。