2024年,AI生成模型领域迎来了一场技术革命,Diffusion Transformer(扩散变换器)成为这一变革的核心驱动力。从大语言模型的架构创新到多模态生成技术的突破,Diffusion Transformer正在重新定义AI的可能性。本文将深入探讨这一技术的前沿进展及其在多个领域的应用。

Diffusion Transformer的技术优势

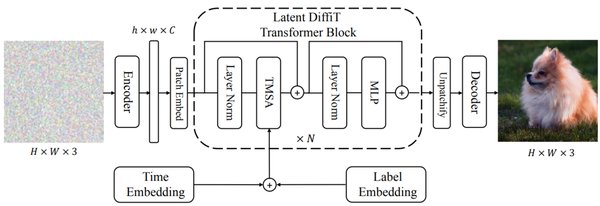

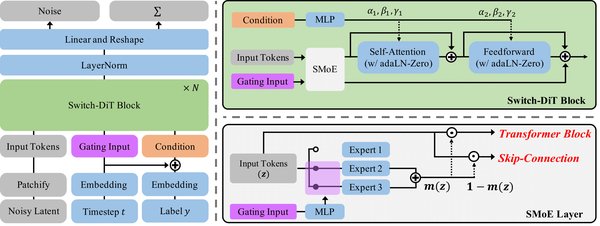

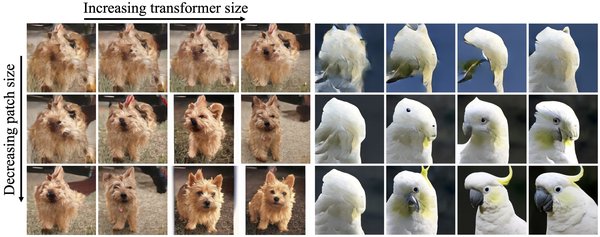

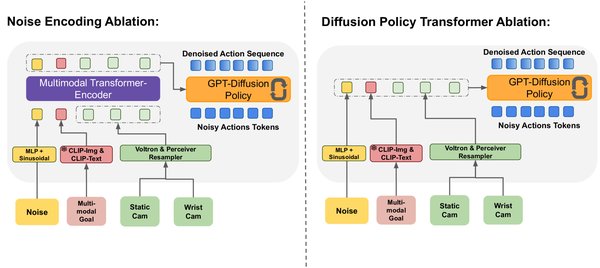

Diffusion Transformer结合了扩散模型和Transformer架构的优势,显著提升了生成模型的效率和性能。扩散模型通过逐步“去噪”生成内容,而Transformer则通过并行处理加速生成过程。这种结合不仅提高了生成速度,还增强了模型对复杂数据的处理能力。

例如,Inception推出的dLLMs(扩散大语言模型)在推理速度和成本上实现了10倍的优化。其并行生成文本的能力,使得模型能够在毫秒级内完成复杂的推理任务,为实时决策系统提供了强大支持。

多模态生成的突破

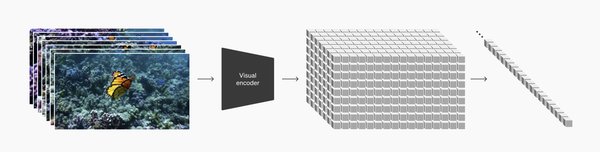

多模态生成是Diffusion Transformer的另一大亮点。阿里巴巴的Wan 2.1模型通过结合扩散模型和Transformer架构,实现了高效的多模态视频生成。其自研的3D因果VAE模块将视频数据压缩256倍,同时保持高质量输出。此外,Wan 2.1还支持中英双语字幕和多语言配音,为视频创作提供了更多可能性。

大语言模型的创新

OpenAI的GPT-4.5是Diffusion Transformer在大语言模型领域的代表。通过教师无监督学习的规模化,GPT-4.5在事实准确性和创造性生成上取得了显著提升。其“EQ”(情商)的提升使得模型在自然对话中表现更加人性化,为企业和创作者提供了更可靠的AI助手。

未来展望

Diffusion Transformer技术的快速发展为AI领域带来了无限可能。从视频生成到多模态分析,从大语言模型到智能体应用,这一技术正在推动AI向更高效、更智能的方向迈进。未来,随着技术的进一步成熟,Diffusion Transformer有望在更多领域实现突破,为人类创造更多价值。

Diffusion Transformer不仅是AI生成模型的技术革新,更是推动AI应用广泛落地的关键力量。无论是企业还是开发者,都应密切关注这一技术的发展,抓住AI时代的机遇。