SophonLLM:企业级大模型运营管理的核心平台

随着人工智能技术的快速发展,大模型在企业中的应用日益广泛。然而,如何高效管理这些大模型,实现资源优化与性能提升,成为企业面临的重要挑战。SophonLLM作为一款企业级大模型运营管理平台,凭借其强大的功能与灵活的部署能力,正在成为这一领域的领航者。

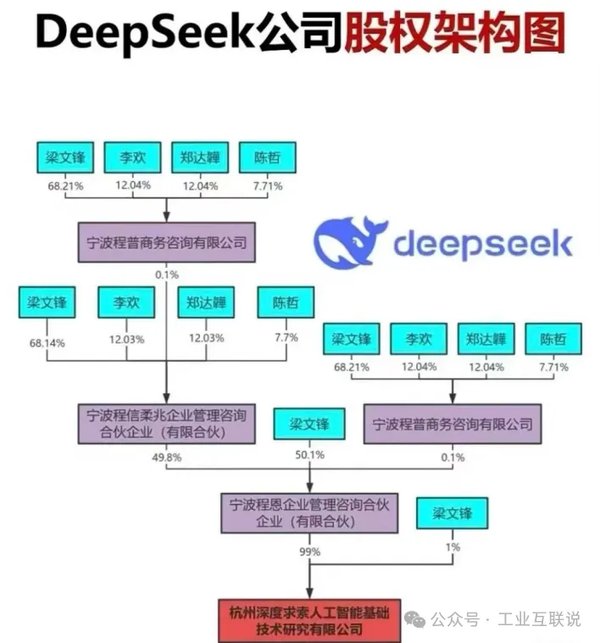

支持DeepSeek R1,赋能大模型管理

SophonLLM全面支持DeepSeek R1全参版本及蒸馏版本。DeepSeek R1是基于DeepSeek-V3-Base训练的先进AI模型,通过强化学习技术显著提升了推理能力,并在多个基准测试中表现优异。SophonLLM为企业提供了统一的管理平台,无论是开源大模型还是商业化大模型,都能在平台上实现高效纳管,确保模型资源的充分利用。

异构算力混合部署,资源精细化调度

在算力资源管理方面,SophonLLM支持国内外GPU/NPU(ARM/x86)异构算力的混合部署。这种灵活的部署方式不仅能够满足企业对不同算力资源的需求,还能通过资源精细化切分与调度,最大化提升算力利用率,降低企业运营成本。

全局监控与效果评估,保障应用性能

SophonLLM还提供了全局状态监控及预警功能,帮助企业实时掌握模型运行状态,及时发现并解决问题。同时,平台支持模型及应用效果评估,确保大模型在实际应用中的性能与稳定性,为企业决策提供可靠的数据支持。

助力企业AI转型,推动行业创新

SophonLLM的推出,不仅为企业提供了高效的大模型管理工具,还推动了AI技术在各行业的深度应用。无论是金融、政府、交通,还是能源、制造、医疗,SophonLLM都能为企业提供定制化的解决方案,助力企业实现智能化转型。

总结

SophonLLM作为企业级大模型运营管理平台,凭借其强大的功能与灵活的部署能力,正在成为企业AI应用的重要支撑。通过支持DeepSeek R1、异构算力混合部署及资源精细化调度,SophonLLM为企业提供了高效、可靠的AI模型管理解决方案,助力企业在智能化时代中赢得竞争优势。