深度造假:技术与法律的交锋

近期,知名歌星泰勒·斯威夫特的AI不雅照在网上疯传,这一事件不仅引发了公众对AI技术的担忧,也促使全球范围内对深度造假问题的立法和技术应对展开了深入讨论。深度造假(Deepfake)是指利用人工智能技术生成逼真的虚假图像、视频或音频,这些内容往往被用于恶意目的,如诽谤、诈骗或侵犯隐私。

全球立法进展

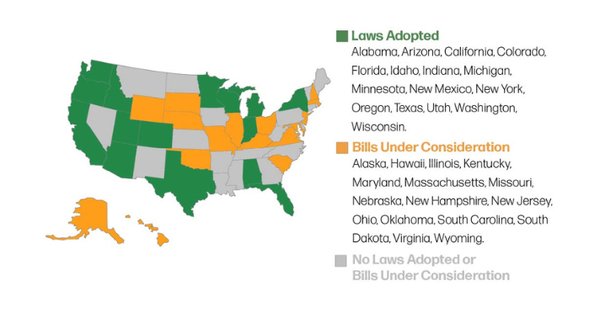

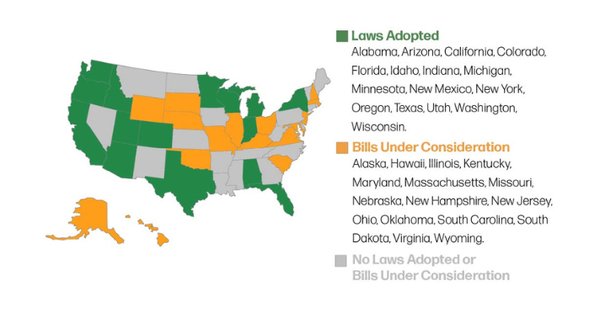

面对深度造假带来的挑战,美国、欧洲和中国等国家和地区正在积极推动相关立法。这些立法旨在明确AI生成内容的合法性边界,并对恶意使用AI技术的行为进行严厉打击。例如,美国已提出多项法案,要求对AI生成内容进行标识,并禁止未经许可使用他人肖像进行深度造假。

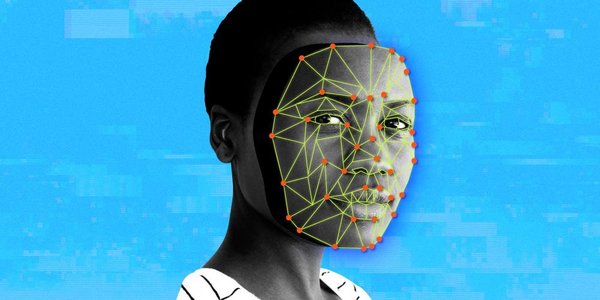

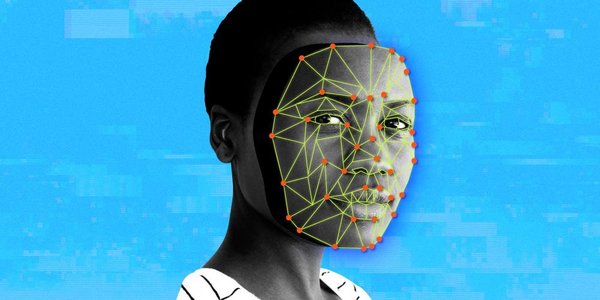

技术手段的应对

除了立法,技术手段在应对深度造假问题中也扮演着关键角色。以下是一些主要的技术应对措施:

-

AI识别技术:通过训练AI模型识别深度造假内容,可以有效检测和过滤虚假信息。

-

数字水印:在AI生成内容中嵌入数字水印,可以帮助追踪和验证内容的真实性。

-

内容审核平台:建立专门的内容审核平台,利用AI和人工审核相结合的方式,快速识别和处理深度造假内容。

生成式AI的双刃剑

尽管深度造假带来了诸多问题,但生成式AI技术本身并非罪魁祸首。事实上,生成式AI在艺术创作、医疗诊断和教育等领域具有广泛的应用前景。关键在于如何规范技术使用,防止其被不法分子利用。

结论

深度造假问题不仅是技术挑战,更是法律和伦理问题。通过立法和技术手段的双重努力,我们可以在打击深度造假的同时,推动生成式AI技术的健康发展。未来,随着技术的进步和法律的完善,深度造假问题有望得到有效控制,从而为AI技术的广泛应用创造更加安全的环境。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...