2023年,人工智能(AI)技术取得了显著进展,特别是在大模型和神经网络领域。ChatGPT等聊天机器人的广泛应用,不仅改变了人机交互的方式,也引发了社会各界对AI技术潜在威胁和挑战的深入讨论。本文将回顾2023年AI技术的重大突破,探讨ChatGPT与DeepSeek的技术路线差异,以及图灵奖对强化学习领域的认可。

神经网络与混合专家系统的技术突破

ChatGPT的全域共振模式

ChatGPT的GPT-4架构包含16个专家子网络,每个专家由约1110亿参数构成。处理输入时,路由算法会同时激活8-12个专家模块,形成跨领域的知识共振。这种设计使得复杂问题能够同步唤醒多个专家系统,但同时也带来了较高的算力消耗和内存带宽需求。

DeepSeek的激光制导模式

DeepSeek-v2采用动态专家选择算法,其专家池包含32个细分领域模块。通过预训练的领域分类器,系统能在50ms内锁定1-3个相关专家。这种精准激活模式显著提高了效率,参数使用量减少68%,显存占用下降至ChatGPT的41%,更适合部署在边缘计算设备。

强化学习与图灵奖的认可

强化学习的奠基性贡献

2024年图灵奖颁给了强化学习之父Andrew G. Barto和Richard S. Sutton,以表彰他们为强化学习奠定了概念和算法基础。从1980年代开始,二人就引入了强化学习的核心理念,构建了数学基础,并开发了关键算法。他们的著作《强化学习导论》至今仍被视为该领域的奠基之作。

强化学习的应用与挑战

强化学习在AlphaGo战胜人类围棋选手、ChatGPT的训练中取得了显著成功。然而,Sutton认为当前的AI系统并未真正实现从经验中学习,ChatGPT等大语言模型仅从海量历史数据中提取信息生成回应,缺乏真正的认知能力。

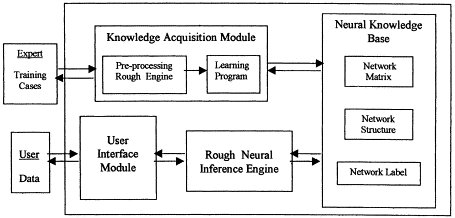

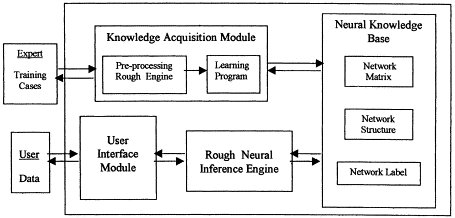

知识蒸馏与模型优化

DeepSeek-R1的知识蒸馏技术

DeepSeek-R1通过知识蒸馏技术,将大型教师模型的知识迁移到小型学生模型,实现模型压缩与加速。该技术包括双模型协同训练、知识迁移机制、损失函数设计和动态温度调节等核心流程,显著提升了模型的效率和性能。

模型评估与优化策略

在模型评估与优化方面,DeepSeek采用了量化评估指标和性能优化技巧,如层融合技术、动态量化和缓存优化等。这些策略不仅提高了模型的推理速度和内存占用,还确保了知识迁移的高效性。

未来展望

2023年AI技术的快速发展,特别是在神经网络、强化学习和混合专家系统等方面的突破,为未来的AI应用奠定了坚实基础。ChatGPT与DeepSeek的技术路线差异,揭示了AI技术在全域联结与深度聚焦两种模式间的平衡与选择。图灵奖对强化学习领域的认可,进一步推动了AI技术向更智能、更高效的方向发展。

未来的智慧图景,可能会是全域联结与深度聚焦两种模式结合后的和谐共鸣。随着AI技术的不断演进,人类将学会在两种模式间自如穿梭,开启真正的认知革命。