测试时间缩放:AI推理效率的革命性突破

测试时间缩放(Test Time Scaling)是AI模型推理阶段的关键技术,旨在通过优化计算资源分配,提升模型在推理任务中的效率。DeepSeek R1模型在这一领域的创新,不仅显著降低了计算成本,还为AI的广泛应用铺平了道路。

DeepSeek R1模型的技术核心

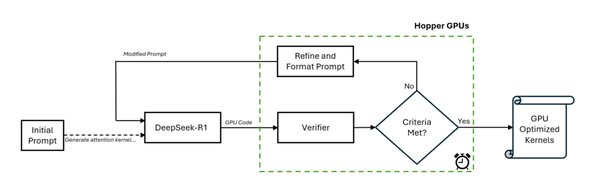

DeepSeek R1模型采用了以下技术,实现了测试时间缩放的优化:

1. 低秩KV压缩技术:通过将键值(KV)矩阵压缩为低秩形式,减少推理时的内存占用,同时保持性能。

2. 动态负载均衡算法:优化GPU流多处理器(SM)的利用率,将空闲周期从18%压缩至2.1%。

3. 异步执行引擎:将GEMM与softmax操作重叠,使计算单元利用率突破75%的理论极限。

这些创新使得R1模型在英伟达H800 GPU上实现了3000GB/s的内存带宽和580TFLOPS的计算性能,显著提升了推理效率。

测试时间缩放对AI基建产业链的影响

测试时间缩放技术的应用,对AI基建产业链的多个环节产生了深远影响:

| 细分领域 | 影响分析 |

|---|---|

| GPU需求 | 尽管R1模型降低了单次推理的计算成本,但其对高性能GPU的需求并未减少,反而因推理任务的复杂性增加而提升。 |

| 光模块 | 随着推理任务的扩展,对高速率光模块的需求持续增长,尤其是1.6T及800G光模块。 |

| 存储 | 低秩KV压缩技术减少了对显存的依赖,但对高效分布式存储系统的需求增加。 |

| 服务器OEM | 服务器制造商需要优化硬件架构,以支持R1模型的高效推理任务。 |

DeepSeek R1模型的商业价值

DeepSeek R1模型的开源和广泛应用,为AI行业带来了显著的商业价值:

– 成本效益:在8K上下文长度的客服对话场景中,单个H800 GPU的并发处理能力从120 QPS提升至692 QPS,单次推理成本从0.0023美元降至0.0007美元。

– 市场潜力:随着计算成本的降低,AI在消费者和企业市场中的潜在投资回报率(ROI)显著提升,推动了AI应用的普及。

未来展望:测试时间缩放的进一步优化

测试时间缩放技术的发展,为AI模型的推理效率优化提供了新的方向。未来,随着更多精准高效的方法出现,AI模型的性能将进一步提升。例如,DeepSeek的多头潜注意力(MLA)技术通过重构KV缓存机制,为大模型计算开辟了新的路径。

此外,随着大模型架构的发展,Prefill和KV Cache容量瓶颈问题正在被逐步克服,大型KV缓存的问题正在成为过去。

结语

DeepSeek R1模型通过测试时间缩放技术的创新,不仅提升了AI推理的效率,还重塑了AI基建产业链的生态。随着计算成本的降低和AI应用的普及,R1模型有望成为推动AI行业发展的关键力量。未来,测试时间缩放技术的进一步优化,将为AI模型的性能提升带来更多可能性。