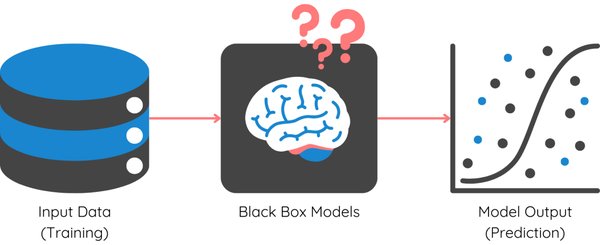

在人工智能(AI)技术快速发展的今天,AI模型已广泛应用于医疗、金融、自动驾驶等关键领域。然而,随着AI系统的复杂性增加,其决策过程往往变得难以理解,甚至被称为“黑箱”。这种不可解释性不仅降低了用户对AI的信任,还可能带来潜在的风险。因此,可解释人工智能(XAI)应运而生,成为解决这一问题的关键。

什么是可解释人工智能(XAI)?

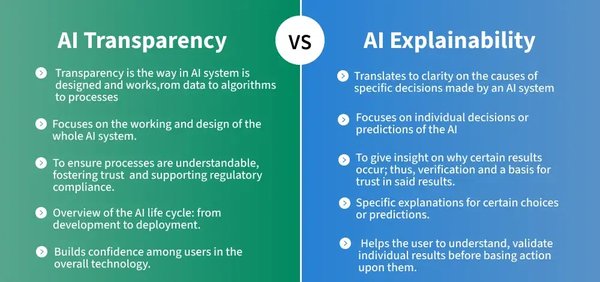

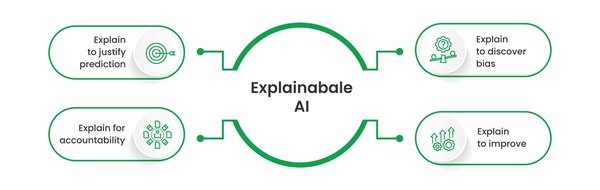

可解释人工智能(XAI)旨在使AI系统的决策过程透明化,帮助用户理解模型如何得出特定结论。与传统的AI模型不同,XAI不仅关注模型的性能,还强调其可解释性和透明度。这一领域的研究包括开发新的算法、工具和框架,以增强AI模型的解释能力。

为什么XAI如此重要?

- 增强用户信任:用户更倾向于信任那些能够解释其决策过程的AI系统。

- 降低风险:在医疗、金融等高风险领域,透明的AI决策可以减少错误带来的负面影响。

- 促进人机协作:XAI帮助用户更好地理解AI系统的局限性,从而更有效地与AI协作。

XAI的研究进展与工具

近年来,XAI领域取得了显著进展。例如,美国国防高级研究计划局(DARPA)赞助的XAI计划,致力于开发更易于理解的AI系统。研究人员还提出了AIQ(人工智能商数)工具包,旨在提高用户对AI系统的理解能力。以下是一些关键的XAI工具:

| 工具名称 | 功能描述 |

|---|---|

| 认知指导 | 提供用户对AI系统如何工作、失效及调整的全面理解 |

| 可解释性量表 | 评估用户对AI系统的信任度、解释满意度和心理模型充分性 |

| 自我解惑评分卡 | 衡量AI技术的可解释性,帮助用户更容易理解系统的决策过程 |

XAI的应用场景

XAI的应用场景广泛,涵盖了从医疗诊断到金融风险评估的多个领域。例如,在医疗领域,XAI可以帮助医生理解AI模型如何诊断疾病,从而提高诊断的准确性。在金融领域,XAI可以解释信用评分模型的决策过程,增强用户对模型的信任。

未来发展方向

尽管XAI已取得显著进展,但仍面临一些挑战。例如,如何平衡模型的性能与可解释性,以及如何开发适用于不同领域的通用XAI工具。未来的研究方向可能包括:

- 开发更高效的XAI算法:在保持模型性能的同时,增强其解释能力。

- 整合用户反馈:通过用户评估优化XAI工具的设计与应用。

- 跨领域应用:将XAI技术推广到更多领域,如教育、法律等。

结语

可解释人工智能(XAI)是AI技术发展的重要方向,它不仅增强了用户对AI系统的信任,还促进了人机协作的有效性。随着研究的深入,XAI有望在更多领域发挥其价值,推动AI技术向更透明、更可信的方向发展。

通过XAI,我们正在逐步揭开AI“黑箱”的神秘面纱,迈向一个更加透明与智能的未来。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...