引言

随着深度学习技术的不断发展,对比学习作为一种新兴的学习方法,在分类任务中展现出了显著的优势。本文将从对比学习的基本原理出发,探讨其在分类改进方法中的应用,并结合实际案例展示其在不同领域的创新应用。

对比学习的基本原理

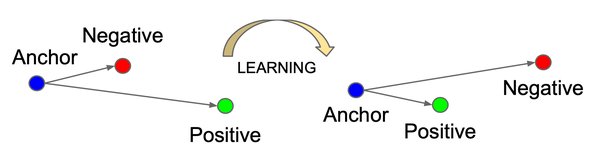

对比学习(Contrastive Learning)是一种通过对比正负样本来学习特征表示的机器学习方法。其核心思想是通过最大化正样本对的相似性,同时最小化负样本对的相似性,从而学习到更具判别性的特征表示。

对比学习的关键步骤

- 数据增强:通过数据增强技术生成正样本对,增加数据的多样性。

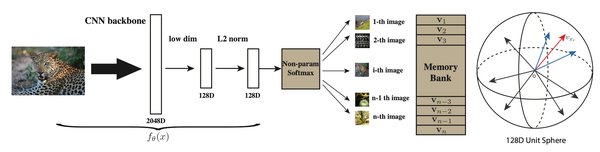

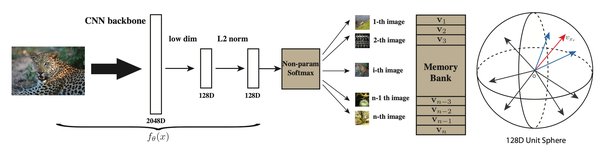

- 特征提取:利用深度神经网络提取样本的特征表示。

- 对比损失:通过对比损失函数优化特征表示,使得正样本对的特征表示尽可能接近,负样本对的特征表示尽可能远离。

对比学习在分类改进中的应用

对比学习在分类任务中的应用主要体现在特征提取和模型优化两个方面。

特征提取

传统的分类方法通常依赖于手工设计的特征,而对比学习能够自动学习到更具判别性的特征表示。例如,在图像分类任务中,对比学习能够捕捉到图像中的细微差异,从而提高分类精度。

模型优化

对比学习通过优化对比损失函数,能够有效提升模型的鲁棒性。例如,在文本分类任务中,对比学习能够减少噪声数据对模型的影响,从而提高模型的泛化能力。

实际案例分析

案例一:图像分类

在图像分类任务中,对比学习通过数据增强和特征提取,能够显著提升分类精度。例如,在医学图像分类中,对比学习能够捕捉到病变区域的细微特征,从而提高诊断的准确性。

案例二:文本分类

在文本分类任务中,对比学习通过优化对比损失函数,能够有效提升模型的鲁棒性。例如,在情感分析任务中,对比学习能够减少噪声数据对模型的影响,从而提高模型的泛化能力。

对比学习与传统分类方法的对比

| 方法 | 特征提取 | 模型优化 | 分类精度 | 鲁棒性 |

|---|---|---|---|---|

| 传统分类方法 | 手工设计 | 交叉熵 | 一般 | 一般 |

| 对比学习 | 自动学习 | 对比损失 | 高 | 高 |

结论

对比学习作为一种新兴的学习方法,在分类任务中展现出了显著的优势。通过对比传统分类方法,本文揭示了对比学习在提升分类精度和鲁棒性方面的潜力。未来,随着对比学习技术的不断发展,其在分类改进方法中的应用将会更加广泛和深入。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...