LSTM与深度学习的演进

LSTM(长短期记忆网络)作为深度学习领域的重要里程碑,解决了传统RNN在处理长序列数据时的梯度消失问题。其设计灵感源于对生物神经元的模拟,这与McCulloch和Pitts在1940年代提出的早期人工神经元模型一脉相承。尽管LSTM在自然语言处理和时间序列预测中取得了显著成功,但其发展也反映了深度学习领域的整体趋势:从简单的线性模型到复杂的非线性网络,从理论探索到实际应用。

深度学习的“10层假说”与非线性动态

在深度学习的理论研究中,一个关键问题是:为什么深度网络比浅层网络表现更好?Ilya Sutskever提出的“10层假说”认为,深度网络通过分层特征提取,能够更高效地捕捉数据中的复杂模式。这一假说在LSTM中得到了验证,其多层结构使得网络能够同时处理短期和长期依赖关系。

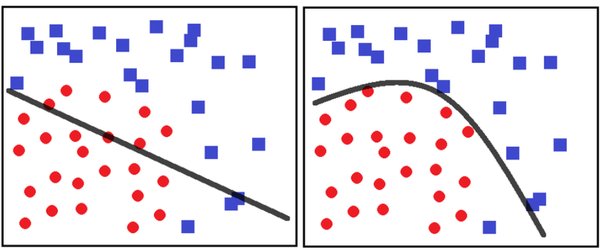

此外,深度学习中的非线性动态也值得关注。研究表明,即使是深度线性网络,其权重更新的动态过程也表现出非线性特征,例如学习曲线中的“平台期”和“快速过渡期”。这些现象与LSTM在实际训练中的行为高度一致,进一步揭示了深度学习的内在机制。

自回归模型的突破与AI推理能力

自回归模型(如GPT系列)的崛起标志着深度学习从单纯的模式识别向更高层次的推理能力迈进。LSTM作为自回归模型的前身,为这一发展奠定了重要基础。通过引入注意力机制和更深的网络结构,现代自回归模型能够生成连贯的文本、完成复杂的逻辑推理任务,甚至展现出一定的创造性。

Ilya Sutskever在NeurIPS 2024上指出,AI的推理能力将成为未来超级智能系统的核心特征之一。这不仅要求模型具备强大的计算能力,还需要对数据的内在逻辑和因果关系有深刻的理解。LSTM在这一领域的探索,为未来的研究提供了宝贵的经验。

超级智能系统的三大特征

根据Ilya Sutskever的预测,未来的超级智能系统将具备以下三大特征:

1. 自我优化能力:系统能够自主调整其结构和参数,以适应不断变化的任务需求。

2. 多模态理解能力:系统能够同时处理文本、图像、声音等多种类型的数据,并实现跨模态的信息融合。

3. 因果推理能力:系统不仅能够识别数据中的模式,还能够理解其背后的因果关系,从而做出更合理的决策。

这些特征与LSTM的设计理念不谋而合,例如其记忆单元的设计就是为了更好地捕捉时间序列中的因果关系。

结语

从LSTM到超级智能,深度学习的发展历程充满了挑战与机遇。Ilya Sutskever的演讲不仅为我们描绘了未来的蓝图,也提醒我们:尽管预训练模式可能即将终结,但深度学习的探索之路远未结束。通过对LSTM等经典模型的深入研究,我们或许能够找到通向超级智能的钥匙。