预训练时代的终结

在2024年NeurIPS会议上,OpenAI联合创始人Ilya Sutskever发表了一场引人深思的演讲,他宣布了一个重要的转折点:预训练模式已经走到尽头。这一观点不仅是对当前AI发展现状的总结,更是对未来方向的深刻洞察。

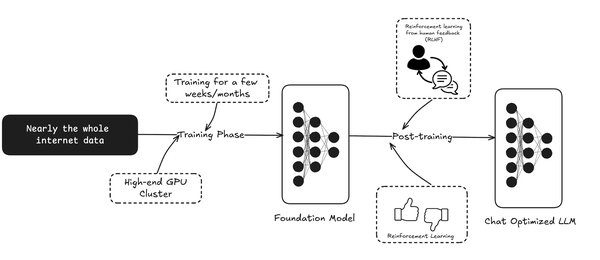

Sutskever指出,尽管预训练模型(如GPT系列)在过去几年中取得了巨大成功,但它们的局限性也日益显现。随着计算能力的提升,模型的规模不断扩大,但数据的增长速度并未同步。这种不平衡导致了“更大并不一定更好”的现象,尤其是在推理能力和复杂任务处理上,预训练模型的表现逐渐达到瓶颈。

超级智能的三个关键特征

Sutskever在演讲中提出了未来超级智能系统的三个关键特征:

- 测试时计算(Test-Time Computation):未来的AI系统将不再依赖预训练,而是通过测试时的逐步推理来解决问题。这种方法强调模型在运行时的思考能力,而非单纯依赖预先学习的数据。

- 多路径推理(Multi-Path Reasoning):AI系统将能够生成多种解决方案,并通过评估选择最优路径。这种能力将使AI在处理复杂问题时更加灵活和高效。

- 透明性与可解释性(Transparency and Interpretability):随着AI系统的复杂性增加,确保其决策过程的可解释性变得至关重要。未来的超级智能系统将更加注重透明性,以便人类能够理解和信任其决策。

深度学习的“10层假说”与自回归模型的突破

Sutskever还回顾了深度学习的“10层假说”,即神经网络的深度与其性能之间的关系。他提到,早期的深度学习研究主要集中在如何通过增加网络层数来提升模型性能,但这一方法在达到一定深度后,收益逐渐递减。

此外,Sutskever讨论了自回归模型(如GPT系列)的突破性认知。这些模型通过预测下一个词来生成连贯的文本,展示了语言模型的强大能力。然而,他也指出,自回归模型在处理复杂推理任务时仍存在局限性,尤其是在需要长期记忆和多步推理的场景中。

AI推理能力的深刻见解

Sutskever强调,未来的AI发展将更加注重推理能力的提升。他指出,当前的预训练模型虽然在生成文本和简单任务上表现出色,但在需要深层次推理的任务上仍显不足。未来的AI系统将通过测试时计算和多路径推理,逐步提升其推理能力,从而更好地应对复杂任务。

行业的影响与未来展望

Sutskever的演讲不仅是对技术趋势的预测,也对整个AI行业产生了深远影响。随着预训练模式的终结,行业将转向更加注重推理能力和透明性的新范式。这一转变将推动硬件市场的变化,传统的AI训练硬件(如NVIDIA的GPU)可能面临挑战,而新的计算范式(如Groq的芯片)将迎来机遇。

此外,Sutskever的观点也引发了关于AI安全性的讨论。他提到,随着AI系统的复杂性增加,确保其安全性和可控性变得尤为重要。未来的AI发展需要在技术进步与安全性之间找到平衡,以确保AI的长期发展对人类有益。

结论

Ilya Sutskever在NeurIPS 2024的演讲为AI的未来描绘了一幅清晰的蓝图。预训练时代的终结标志着AI发展进入了一个新的阶段,未来的超级智能系统将更加注重推理能力、透明性和安全性。这一转变不仅将推动技术的进步,也将对整个行业产生深远影响。随着AI的不断发展,我们正迈向一个更加智能和可控的未来。