Deepfake技术的崛起与风险

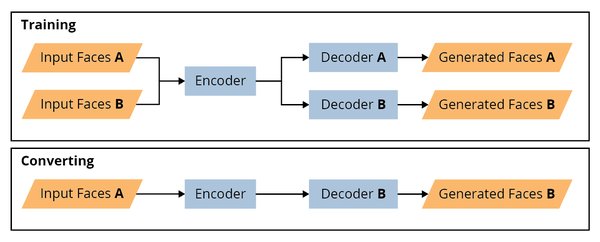

Deepfake技术,即通过人工智能深度学习模型生成逼真的虚假内容,近年来在全球范围内引发了广泛关注。这种技术不仅能够生成逼真的图像和视频,还能够模拟声音,甚至创造出几乎无法分辨真伪的虚拟人物。然而,随着技术的普及,Deepfake也带来了诸多风险,尤其是在欺诈、隐私侵犯和虚假信息传播等方面。

近期,韩国曝出的Deepfake女性受害事件再次将这一技术推上风口浪尖。受害者不仅遭受了心理上的创伤,还面临着社会舆论的压力。这一事件引发了全球范围内对Deepfake技术滥用问题的深刻反思。

开源模型:对抗Deepfake的新希望

在这样的背景下,中科院女工程师张欣怡宣布其团队将参加外滩大会AI创新赛·全球Deepfake攻防挑战赛,并将参赛的AI模型开源。这一举措旨在通过降低技术使用门槛,让更多人参与到对抗Deepfake技术的行列中来。

张欣怡所在团队VisionRush已将参赛模型分享至Github,供全球开发者使用和优化。开源模型的推出不仅有助于提升技术透明度,还能够加速相关技术的研发和普及,从而更有效地对抗Deepfake带来的风险。

外滩大会:Deepfake攻防实战演练

外滩大会首次增设“科技智能创新大赛”,其中Deepfake大赛针对“AI换脸”欺诈风险进行攻防实战演练,并设立了高达100万元人民币的奖金池。这一赛事不仅为全球顶尖AI团队提供了展示和交流的平台,也为Deepfake技术的未来发展指明了方向。

参赛团队将通过实战演练,探索如何有效识别和防御Deepfake技术,从而减少其在社会中的负面影响。这一赛事不仅具有重要的学术价值,更具有广泛的社会意义。

未来展望:技术与伦理的平衡

Deepfake技术的发展无疑为人工智能领域带来了新的机遇,但同时也提出了严峻的伦理挑战。如何在技术进步与伦理约束之间找到平衡,是未来需要深入探讨的问题。

张欣怡团队的开源模型为这一问题的解决提供了新的思路。通过开源,不仅能够促进技术的透明度和可追溯性,还能够激发全球开发者的创新潜力,共同应对Deepfake技术带来的挑战。

结论

Deepfake技术既是机遇也是挑战。通过开源模型和全球性的攻防实战演练,我们有望在技术发展和伦理约束之间找到平衡,从而更好地利用这一技术,守护真实世界。

| 技术 | 风险 | 应对措施 |

|---|---|---|

| Deepfake | 欺诈、隐私侵犯、虚假信息传播 | 开源模型、攻防实战演练、伦理约束 |

在未来的发展中,我们期待看到更多像张欣怡团队这样的创新者,为Deepfake技术的健康发展贡献力量。