AI交流(进群备注:Xorbits Inference)

Xorbits Inference(Xinference)是一个功能全面的分布式推理框架,支持大语言模型(LLM)、语音识别模型、多模态模型等各种模型的推理。它适用于研究者、开发者和数据科学家,支持一键部署自定义模型或内置开源模型,可在笔记本电脑、千节点集群及边缘设备上运行。

Xorbits Inference的特点:

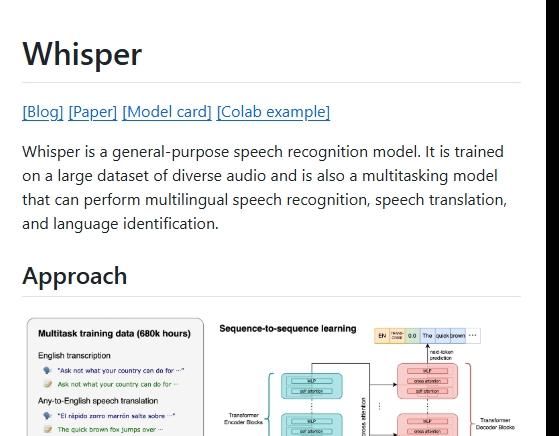

- 1. 支持大语言模型(LLM)、语音识别模型和多模态模型

- 2. 一键部署自定义模型或内置开源模型

- 3. 支持千节点集群部署百亿参数模型

- 4. 单卡RTX 4090运行Llama3-70B达158 tokens/s

- 5. 冷启动时间<3秒

- 6. 动态资源分配:根据请求负载自动调整GPU内存

- 7. 多模型兼容:同时运行20+模型实例

- 8. 长文本优化:支持2M tokens上下文窗口

- 9. 优化在M2 Max芯片上的性能

Xorbits Inference的功能:

- 1. 轻松部署自己的模型

- 2. 使用内置的前沿开源模型进行推理

- 3. 为大规模语言模型提供服务

- 4. 实现语音识别模型的集成

- 5. 支持多模态模型的应用

- 6. 在本地环境中快速部署和测试各种模型

- 7. 云服务高并发推理

- 8. 边缘设备实时决策

- 9. 多模态联合推理

- 10. 在终端中克隆项目并安装依赖

- 11. 配置模型参数以运行所需的LLaMA2版本

- 12. 使用提供的脚本启动推理服务

- 13. 根据需求调整性能参数以优化运行效果

相关导航

暂无评论...