医用人工智能伦理审查框架的背景与意义

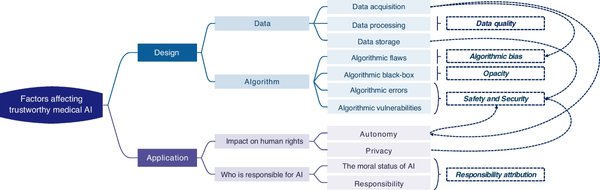

随着人工智能(AI)技术的快速发展,其在医疗领域的应用日益广泛,从医学影像诊断到疾病预测,再到个体化治疗,AI正在深度重塑医学的诊疗模式。然而,AI技术的广泛应用也带来了诸多伦理挑战,如隐私保护、数据安全、算法偏见等问题。因此,建立一套科学、规范的医用人工智能伦理审查框架,对于保护研究参与者的尊严与合理权益,促进AI技术的健康发展具有重要意义。

医用人工智能伦理审查面临的挑战

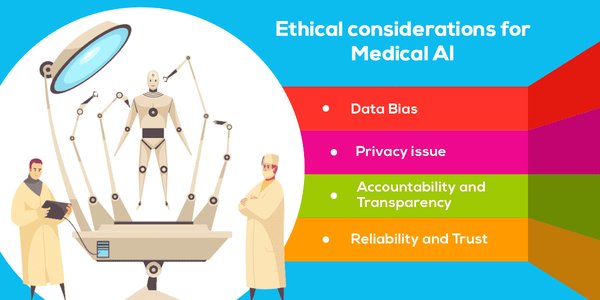

医用人工智能研究伦理审查面临的主要挑战包括:

-

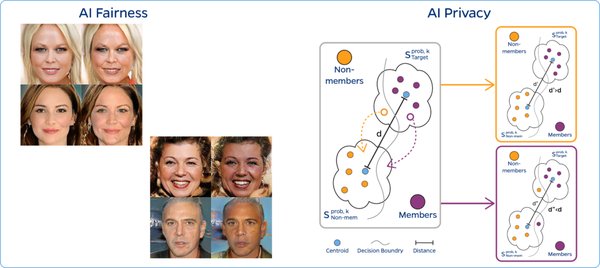

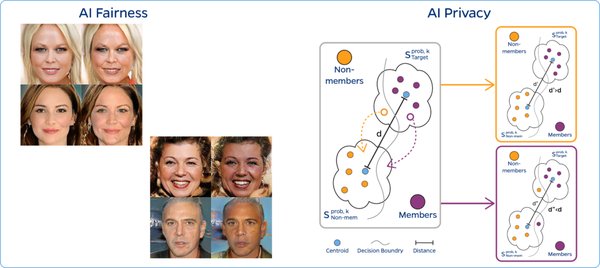

隐私与数据安全:AI技术依赖于大量的医疗数据,如何在数据收集、存储和使用过程中保护患者隐私,是伦理审查的重要议题。

-

算法偏见与公平性:AI算法可能存在偏见,导致不公平的医疗决策,如何确保算法的公平性和透明性,是伦理审查的核心问题。

-

知情同意与权益保护:在AI研究中,如何确保研究参与者的知情同意,并保护其合法权益,是伦理审查的基本要求。

-

伦理风险评估与控制:AI技术的应用可能带来未知的伦理风险,如何科学评估和控制这些风险,是伦理审查的关键任务。

医用人工智能伦理审查框架的构建

基于《科技伦理审查办法(试行)》和《新一代人工智能伦理规范》,医用人工智能伦理审查框架的构建应包括以下几个方面:

-

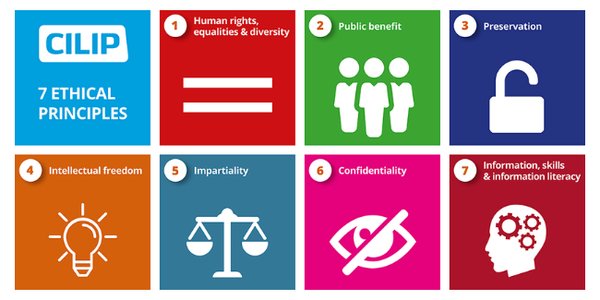

伦理审查原则:遵循增进人类福祉、尊重生命权利、坚持公平公正、合理控制风险、保持公开透明的科技伦理原则。

-

伦理审查机构:设立科技伦理(审查)委员会,由具备相关科学技术背景的同行专家,伦理、法律等相应专业背景的专家组成,确保审查的科学性和独立性。

-

伦理审查程序:制定完善的伦理审查程序,包括申请与受理、一般程序、简易程序、专家复核程序等,确保审查的规范性和透明度。

-

伦理风险管理:建立伦理风险评估机制,对AI研究的潜在伦理风险进行全面评估,并制定相应的风险防控措施和应急预案。

-

伦理跟踪审查:对已批准的AI研究进行跟踪审查,及时发现和处理伦理风险,确保研究过程的合规性和安全性。

医用人工智能伦理审查框架的实施与监督

为确保医用人工智能伦理审查框架的有效实施,需加强以下方面的监督与管理:

-

伦理审查培训:定期开展科技伦理审查业务培训和科技人员的科技伦理知识培训,提高审查人员的专业水平和伦理意识。

-

伦理审查认证:推动建立科技伦理(审查)委员会认证机制,鼓励相关单位开展科技伦理审查认证,提升审查的规范性和权威性。

-

伦理审查报告:要求单位定期提交科技伦理(审查)委员会工作报告和纳入清单管理的科技活动实施情况报告,加强审查的监督和评估。

-

伦理违规处理:对违反科技伦理规范的行为,依法依规进行处罚和处理,确保审查的严肃性和有效性。

结语

医用人工智能伦理审查框架的构建与实施,是保障AI技术在医疗领域健康发展的关键。通过科学、规范的伦理审查,可以有效保护研究参与者的尊严与合理权益,促进AI技术的创新与应用,为人类健康福祉作出更大贡献。