天工大模型3.0:全球MoE模型的巅峰之作

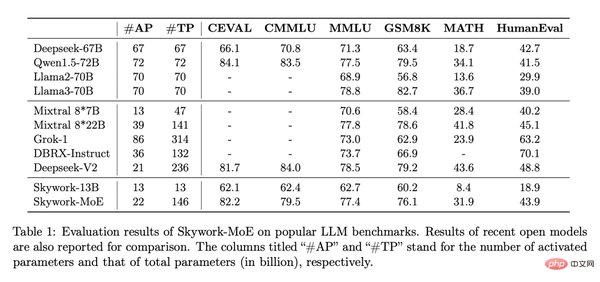

近日,昆仑万维科技公司正式发布了“天工大模型3.0”,这一模型凭借其4000亿级参数的MoE(混合专家模型)架构,迅速成为全球AI领域的焦点。作为目前全球参数规模最大、性能最强的MoE模型之一,天工大模型3.0不仅在技术上实现了突破,更在应用场景中展现了广泛的可能性。

技术突破:MoE架构的卓越性能

MoE(Mixture of Experts)是一种通过组合多个专家模型来处理复杂任务的架构。天工大模型3.0采用了这一架构,结合4000亿级参数的规模,使其在处理大规模数据时表现出极高的效率和精度。相比于传统单一模型,MoE架构能够根据任务需求动态分配资源,从而在复杂场景中实现更优的性能。

应用场景:多领域的智能化转型

天工大模型3.0在多个领域展现了其强大的应用潜力:

-

自然语言处理(NLP):模型在文本生成、语义理解和对话系统等任务中表现优异,能够高效处理多语言、多模态的数据。

-

计算机视觉(CV):通过结合图像和文本信息,模型在图像识别、生成和编辑等任务中实现了高精度的处理能力。

-

推荐系统:天工大模型3.0能够根据用户行为和偏好,提供更加个性化和精准的推荐服务。

行业影响:推动AI生态发展

天工大模型3.0的发布不仅为昆仑万维在AI领域树立了新的标杆,也为全球AI技术的发展注入了新的动力。其开源策略更是推动了全球科研机构、企业和个人开发者的创新合作,加速了AI技术在各行各业的应用落地。

未来展望:持续创新与扩展

昆仑万维表示,未来将继续加大对天工大模型的研发投入,进一步优化模型性能,并探索更多应用场景。随着AI技术的不断进步,天工大模型3.0有望在更多领域发挥其潜力,为全球智能化转型提供强有力的支持。

天工大模型3.0的发布标志着昆仑万维在AI技术领域的又一次重大突破,也为全球AI生态的发展提供了新的方向。无论是技术研究者还是行业从业者,都可以从这一模型中汲取灵感,共同推动AI技术的创新与应用。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...