GPT-2:AI大模型的里程碑

GPT-2作为OpenAI推出的第二代生成式预训练模型,标志着AI大模型在参数规模和应用能力上的重大突破。其基于Transformer架构的设计,不仅解决了传统RNN和LSTM在处理长序列数据时的局限性,还为后续模型如GPT-3和GPT-4的演进奠定了基础。

GPT-2的核心优势在于其强大的语言生成能力。通过大规模的预训练数据,它能够生成连贯且富有逻辑的文本,甚至在某些场景下与人类写作难以区分。这一能力得益于其庞大的参数规模——GPT-2拥有15亿参数,远超其前身GPT-1的1.17亿。

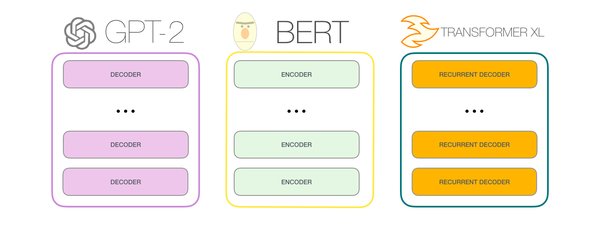

从Transformer到GPT系列:架构的革新

Transformer架构的引入是AI大模型发展的关键转折点。其自注意力机制(Self-Attention)使得模型能够同时处理输入序列中的多个位置信息,从而大幅提升了模型的效率和性能。GPT系列模型正是基于这一架构,通过堆叠多层Transformer模块,实现了对复杂语言模式的理解和生成。

值得一提的是,GPT-2在训练过程中采用了无监督学习的方式,这意味着它不需要大量标注数据即可学习语言的通用特征。这种方法的成功为后续模型的训练提供了重要启示,也推动了迁移学习在AI领域的广泛应用。

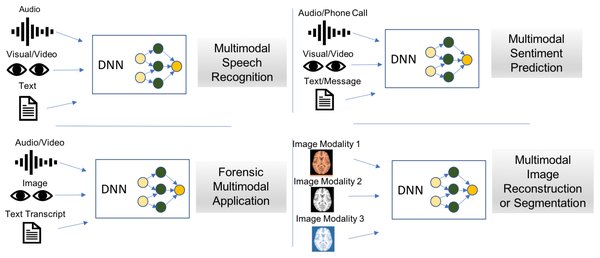

数据模态的融合:从单一到多元

随着AI大模型的发展,数据模态的融合成为新的趋势。GPT-2虽然主要针对文本数据,但其设计理念为多模态模型的开发提供了思路。例如,后续的GPT-3和GPT-4开始尝试将文本、图像、音频等多种数据模态结合起来,以实现更全面的任务解决能力。

这种多模态融合不仅扩展了模型的应用场景,还为其赋予了更强的通用性。例如,在医疗领域,多模态模型可以同时分析患者的病历、影像和语音数据,从而提供更精准的诊断建议。

迁移学习:从预训练到通用任务解决

迁移学习是GPT-2等预训练模型的核心技术之一。通过在大规模数据集上进行预训练,模型能够学习到通用的语言特征,然后在特定任务上进行微调,从而实现高效的任务迁移。这种方法不仅降低了训练成本,还提升了模型在新任务上的表现。

在GPT-2的基础上,研究人员进一步探索了如何将迁移学习应用于更复杂的任务,如机器翻译、文本摘要和对话生成。这些应用的成功证明了预训练模型在通用任务解决能力上的巨大潜力。

未来展望:AI大模型与人形机器人

随着AI大模型的不断发展,其应用范围也在逐步扩展。下一阶段的研究重点之一是如何将这些模型赋能于人形机器人,使其具备通用任务解决能力。例如,通过结合GPT系列模型的自然语言处理能力和机器人的感知与执行能力,可以实现更智能的人机交互和任务完成。

这一目标的实现将面临诸多挑战,包括如何将多模态数据与机器人控制系统结合、如何提升模型在复杂环境中的适应性等。然而,随着技术的进步,这些问题有望逐步得到解决,从而推动人形机器人向更智能、更通用的方向发展。

结语

从GPT-2到通用AI,AI大模型的发展历程充满了创新与突破。Transformer架构的引入、数据模态的融合以及迁移学习的应用,共同推动了这一领域的快速进步。未来,随着技术的不断演进,AI大模型将在更多领域发挥重要作用,尤其是人形机器人的通用任务解决能力,将成为下一个研究热点。