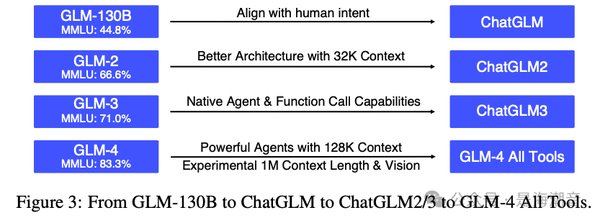

对称Transformer架构的创新设计

GLM-4-9B模型在架构设计上采用了对称Transformer架构,这一创新设计显著提升了模型的训练和推理效率。对称Transformer架构通过优化模型的计算流程,减少了不必要的计算开销,使得模型在处理大规模数据时能够更加高效地运行。此外,该架构还支持动态填充缺失信息,进一步增强了模型在多任务场景中的适应性。

多任务场景中的出色表现

GLM-4-9B模型在多任务场景中表现出色,其生成-填充混合任务优化能力使得模型能够同时处理多种不同类型的任务。例如,在医疗文本分析中,模型能够准确地识别和填充缺失的医疗信息;在跨语言搜索和机器翻译中,模型能够高效地处理不同语言之间的转换任务。这些能力使得GLM-4-9B模型在多个领域中都具有广泛的应用前景。

参数高效微调技术

GLM-4-9B模型还支持参数高效微调技术,这一技术显著降低了模型在特定任务中的计算资源需求。通过参数高效微调,模型能够在保持高性能的同时,减少对计算资源的依赖,这使得GLM-4-9B模型在金融等领域中具有更高的应用价值。此外,参数高效微调技术还使得模型能够更快地适应新的任务和场景,进一步提升了模型的灵活性。

多模态信息融合能力的优化

GLM-4-9B模型在多模态信息融合能力上进行了优化,使得模型能够更好地处理来自不同模态的信息。例如,在新闻摘要生成和产品描述创建等场景中,模型能够有效地融合文本、图像等多种模态的信息,生成更加准确和丰富的描述。这一能力使得GLM-4-9B模型在内容生成和信息提取等任务中具有更高的表现力。

总结

GLM-4-9B模型通过采用对称Transformer架构、优化多任务处理能力、支持参数高效微调技术以及提升多模态信息融合能力,在自然语言处理领域中表现出色。该模型不仅提高了训练和推理效率,还显著增强了在多任务场景中的适应性和应用价值。未来,随着技术的进一步发展,GLM-4-9B模型有望在更多领域中发挥重要作用。