T5:文本到文本转换的里程碑

在自然语言处理(NLP)领域,Google的T5模型(Text-to-Text Transfer Transformer)无疑是一个里程碑式的创新。作为Transformer架构的杰出代表,T5将各种NLP任务统一为“文本到文本”的框架,显著提升了模型的通用性和效率。

T5的核心技术

T5模型基于Transformer架构,这一架构通过自注意力机制和并行处理能力,彻底改变了NLP领域的游戏规则。T5的核心技术包括:

-

统一的文本到文本框架:无论是文本生成、翻译还是问答,T5都将输入和输出视为文本序列,极大地简化了模型的设计和应用。

-

多任务学习:T5通过在同一模型上训练多种任务,提升了模型的泛化能力。

-

大规模预训练:T5使用了海量的文本数据进行预训练,使其能够捕捉到丰富的语言模式。

-

高效的微调机制:用户可以通过少量数据对T5进行微调,使其适应特定任务。

T5的应用场景

T5模型在多个NLP任务中展现了卓越的性能,包括:

-

文本生成:从新闻报道到创意写作,T5能够生成高质量的文本内容。

-

机器翻译:T5在多种语言的翻译任务中表现出色,接近人类水平。

-

问答系统:T5能够准确理解问题并生成相关答案,提升了对话系统的智能性。

-

文本摘要:T5可以快速提取长文本的核心信息,生成简洁的摘要。

T5的未来发展方向

随着AI技术的不断进步,T5模型也在持续演进。未来的发展方向可能包括:

-

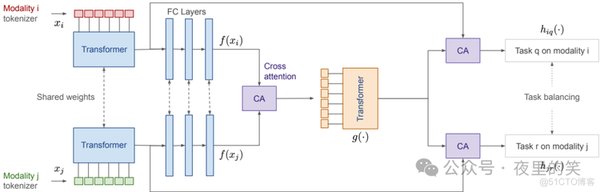

多模态能力:将T5与图像、音频等多模态数据结合,拓展其应用场景。

-

边缘计算:优化T5的计算效率,使其能够在移动设备上运行。

-

生物启发式设计:借鉴人类认知机制,进一步提升模型的理解和生成能力。

-

量子计算:利用量子计算的潜力,加速T5的训练和推理过程。

结语

T5模型作为Google在NLP领域的代表作,不仅推动了文本生成和理解技术的进步,也为未来的AI应用开辟了新的可能性。随着技术的不断发展,T5将继续在人工智能领域发挥重要作用,为人类与机器的交互带来更多便利与创新。