Transformer架构:AI技术的革命性突破

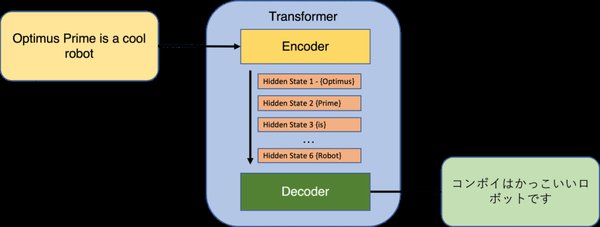

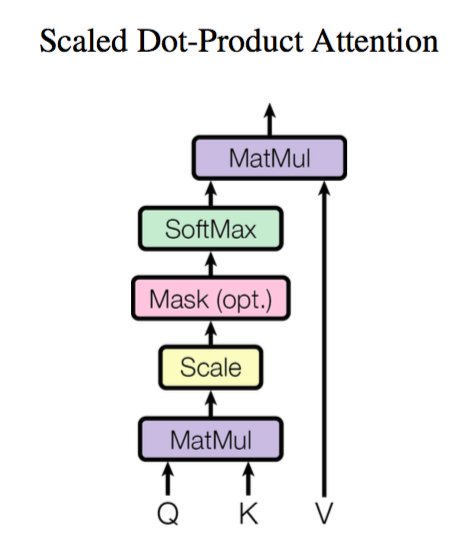

Transformer架构自2017年问世以来,已成为人工智能领域的核心技术之一。其独特的自注意力机制和强大的特征抽取能力,使其在自然语言处理(NLP)任务中表现卓越。近年来,Transformer不仅在对话生成系统中大放异彩,还在芯片设计领域掀起了一场技术革命。

Transformer在对话生成系统中的应用

在自然语言处理领域,Transformer架构的应用显著提升了对话生成系统的性能。以ChatGPT和Sora为例,二者均基于Transformer模型,但在实现方式和应用场景上各有特色。

ChatGPT:自然性与多样性的典范

ChatGPT通过大规模文本数据训练,利用Transformer的自注意力机制捕捉语境信息,生成连贯、自然的对话内容。其灵活性和多样性使其成为广泛应用的对话生成工具。

Sora:精准性与效率的追求

Sora在Transformer基础上引入了更多上下文信息和优化策略,如知识蒸馏和模型压缩,从而实现了更高的生成效率和精准性。其设计理念更注重对话的上下文理解和意图捕捉。

尽管ChatGPT和Sora在应用领域有所差异,但二者都展示了Transformer在对话生成系统中的巨大潜力。未来,随着模型结构的进一步优化和训练数据的丰富,Transformer驱动的对话生成系统将更加智能和高效。

Transformer在芯片设计中的创新实践

Transformer架构不仅在软件层面推动技术进步,还在硬件领域引发了革命性变革。Etched公司推出的Sohu芯片,是全球首款专为Transformer架构设计的ASIC芯片,标志着Transformer在硬件实现上的重要突破。

Sohu芯片的技术亮点

Sohu芯片采用台积电4纳米工艺制造,直接将Transformer架构蚀刻到芯片中,显著提升了推理性能并降低了能耗。在Llama 70B模型中,Sohu每秒可处理超过50万个tokens,为实时语音代理、文本处理和多模态生成等应用提供了强大支持。

未来芯片设计的趋势

Sohu芯片的成功预示着Transformer架构在硬件领域的广阔前景。随着AI模型规模的不断扩大,专为Transformer设计的芯片将成为推动技术发展的重要力量,为万亿级参数模型的运行提供可能。

未来展望:Transformer的无限可能

Transformer架构的应用正在不断拓展,从对话生成到芯片设计,其影响力已渗透到人工智能的各个领域。未来,我们可以期待以下发展趋势:

-

更高效的模型结构:通过技术创新,进一步提升Transformer的性能和效率。

-

多模态融合:将Transformer应用于图像、语音等多模态数据,实现更全面的智能交互。

-

轻量化与个性化:开发更轻量化的模型和定制化解决方案,满足不同行业的需求。

Transformer架构的持续演进,将为人工智能技术带来更多突破,推动智能时代的全面到来。无论是对话生成系统的智能化,还是芯片设计的革新,Transformer都将继续引领技术潮流,为人类创造更加智能、便捷的未来。