ResNet的核心设计:残差块

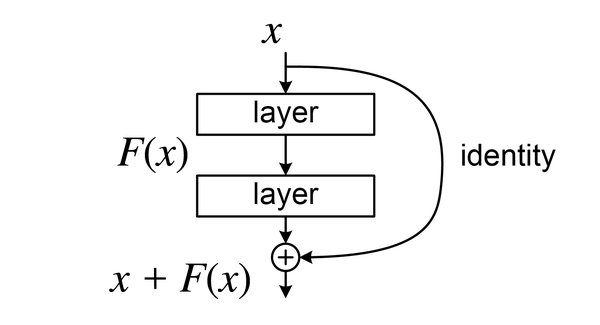

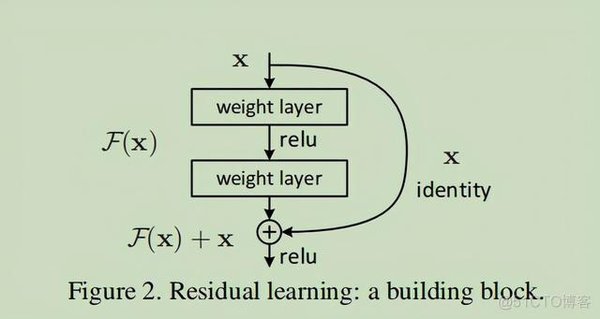

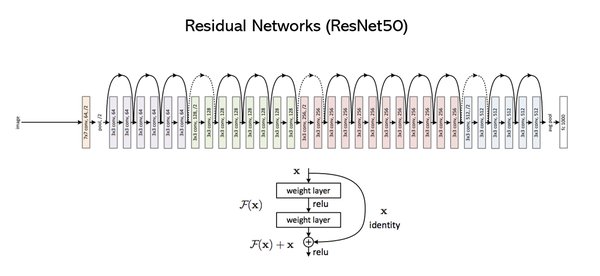

残差网络(ResNet)是深度学习领域的一项重大突破,特别是在图像分类任务中表现出色。其核心设计是残差块(Residual Block),通过引入“跳跃连接”(Skip Connection),解决了深层网络训练中的梯度消失问题。这一设计使得网络能够轻松堆叠到数百层而不崩溃,从而在复杂的视觉任务中表现更优。

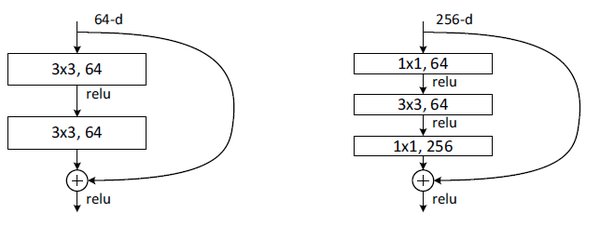

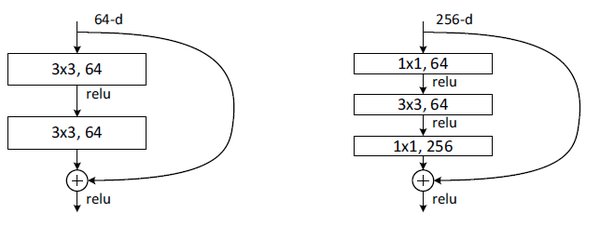

在ResNet-50中,残差块被分为四个主要阶段。每个阶段包含多个瓶颈型残差块(Bottleneck Block),这些块由三个连续的小卷积操作组成:1×1、3×3和1×1卷积核。例如,在第一个残差块组(conv2_x)中,每个残差块的通道数分别为64、64和256。这种设计不仅减少了计算量,还提高了网络的表达能力。

ResNet-50的四个阶段

-

阶段一:初始卷积层

-

在ResNet-50的最开始,有一个单独的7×7卷积层,步幅为2,紧接着是一个最大池化层,同样具有2的步幅。这一部分不计入主要的四个阶段之中。

-

阶段二:第一个残差块组 (conv2_x)

-

此阶段包含了3个瓶颈型残差块,每个残差块由三个连续的小卷积操作组成,分别是1×1、3×3和1×1卷积核大小,通道数分别为64、64和256。

-

阶段三:第二个残差块组 (conv3_x)

-

此阶段包含了4个瓶颈型残差块,通道数分别为128、128和512。

-

阶段四:第三个残差块组 (conv4_x)

-

此阶段包含了6个瓶颈型残差块,通道数分别为256、256和1024。

-

阶段五:第四个残差块组 (conv5_x)

-

此阶段包含了3个瓶颈型残差块,通道数分别为512、512和2048。

在MATLAB中使用ResNet

对于那些希望快速开始实验而不必从头训练整个网络的人来说,可以利用MATLAB内置的支持包来加载预训练好的ResNet模型。这些预训练模型已经在大规模数据集上进行了优化,可以直接用于特征提取或是微调适应新的任务需求。

例如,加载预训练的ResNet-18模型只需一行代码:

“`matlab

net = resnet18;

“`

总结

ResNet通过引入残差块和跳跃连接,解决了深层网络训练中的梯度消失问题,成为AI视觉技术的重要创新。其设计不仅在图像分类任务中表现出色,还推动了深度学习的发展。通过MATLAB等工具,研究人员可以轻松地应用和调整ResNet模型,以适应各种复杂的视觉任务。

ResNet的成功不仅在于其创新的结构设计,更在于其广泛的适用性和高效的性能。无论是学术研究还是工业应用,ResNet都已成为深度学习领域不可或缺的一部分。