神经网络的发展历程

从符号主义到连接主义

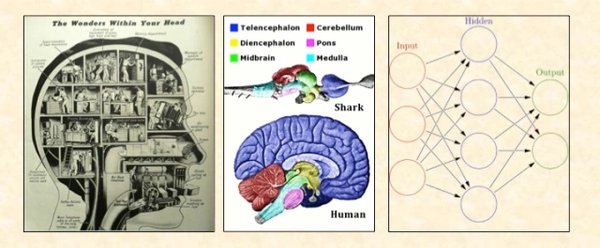

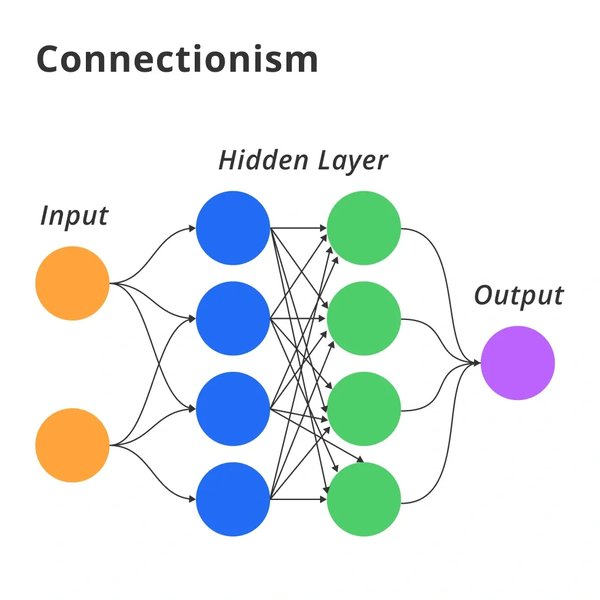

神经网络的发展可以追溯到人工智能的早期历史。最初的人工智能研究以符号主义为主,依赖于手工定义的规则和逻辑推理。然而,符号主义在面对复杂和动态变化的现实世界时表现出明显的局限性。20世纪80年代,连接主义崭露头角,以神经网络为基础的模型开始吸引学术界的关注。随着计算能力的提升和数据获取的便利,连接主义逐渐显示出其在图像识别、自然语言处理等领域的强大能力,深度学习的范式革命正式拉开帷幕。

霍普菲尔德网络与自旋玻璃

约翰·霍普菲尔德是一位理论物理学家,他的霍普菲尔德网络灵感来自凝聚态物理学中的“自旋玻璃理论”。自旋玻璃是磁性系统,其中原子自旋随机定向但固定,寻求能量最小的状态。霍普菲尔德巧妙地将这一物理原理应用于人工神经元,训练霍普菲尔德网络涉及调整这些节点之间的连接,使存储的模式(如图像)对应于低能量状态。

玻尔兹曼机与统计力学

杰弗里·辛顿开发的玻尔兹曼机,灵感来自统计物理学,是向前迈出的关键一步。统计力学为理解复杂、动态系统提供了丰富的词汇和工具。在神经网络领域,这种方法被证明是无可替代的。能量景观这一概念在物理学中用于描述多体系统的行为,而在神经网络中则自然地对应于网络在学习过程中所要遍历的代价函数或误差曲面。

深度学习的工具与平台

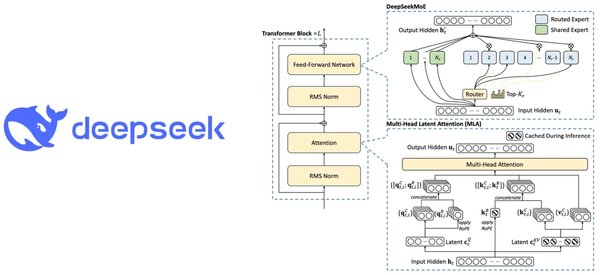

DeepSeek工具生态系统

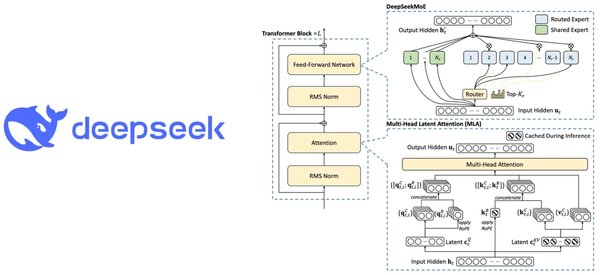

DeepSeek作为一套完整的深度学习工具生态系统,为研究人员和开发者提供了强大的支持。其生态系统包括计算卡支持和分布式训练特性两大核心组件。计算卡支持涵盖了主流的硬件加速器,如NVIDIA的GPU和Google的TPU。分布式训练特性通过支持多节点、多GPU/TPU的协同训练,能够有效地缩短训练时间,提升模型的扩展性和稳定性。

DeepSeek-Env容器化部署

为了便于用户快速上手和部署深度学习应用,DeepSeek推出了DeepSeek-Env,这是一种基于容器化技术的环境配置方案。容器化技术能够有效地解决软件环境依赖复杂、配置繁琐的问题,为深度学习的开发和部署提供了灵活、高效的解决方案。

神经网络的前沿应用

自监督学习的崛起

自监督学习被认为是下一代人工智能发展的关键。与传统的监督学习依赖大量标注数据不同,自监督学习通过让模型从海量未标注数据中自我学习特征,极大地降低了对人工标注的依赖。自监督学习通过设计预任务,例如图像的拼图重建或视频的未来帧预测,让模型在完成这些任务的过程中学习有效的特征表示。

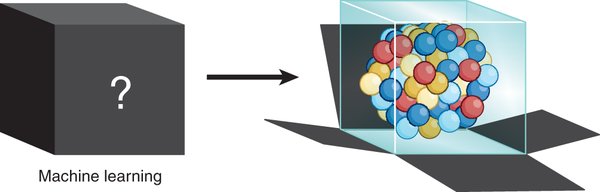

可解释性与透明AI

随着AI在关键领域的应用不断扩大,模型的可解释性和透明度成为不可忽视的重要问题。未来的AI系统不仅要做出准确的决策,还需要能够解释这些决策背后的逻辑和依据。可解释性技术的发展包括可视化工具、可解释模型(如LIME和SHAP)以及对深度神经网络的可解释性增强方法。

跨领域AI与泛化能力

未来的AI系统将不仅仅局限于单一领域或任务,而是能够跨越多个领域进行知识迁移和应用。这种能力需要模型具备强大的泛化能力,以便在不同的环境和数据上依然能够保持良好的性能。跨领域学习需要解决不同领域特征差异、数据分布不一致等问题,这为AI研究带来了新的挑战和机遇。

神经网络在医疗与环境保护中的应用

医疗影像处理与分析

随着医疗数据的数字化,医疗影像处理成为深度学习的重要应用领域之一。深度学习模型,如卷积神经网络(CNN),已在医学成像中取得显著成效。通过将深度学习模型集成到临床决策支持系统中,医生能够获得更为精确的诊断建议和治疗方案。

环境保护与生态健康预测

AI技术在环境保护和生态健康预测中的应用也日益广泛。通过深度学习技术,可以实现对生态系统健康状况的实时监测和预测,帮助制定有效的环境保护策略。深度学习模型能够分析和预测环境变化,为环境保护提供科学依据。

结语

神经网络的发展动态展示了从物理学原理到AI前沿应用的广阔前景。通过跨学科研究和技术创新,神经网络在医疗、环境保护、教育等领域展现出巨大的应用潜力。未来,随着自监督学习、可解释性技术和跨领域AI的进一步发展,神经网络将继续推动人工智能技术的进步,为社会带来更多的福祉。