多模态大模型的崛起

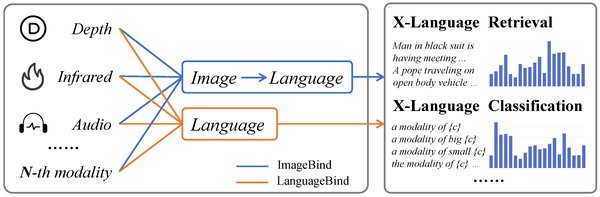

近年来,随着深度学习技术的快速发展,多模态大模型(Large Models)逐渐成为人工智能领域的研究热点。这些模型通过海量数据和强大的计算能力,能够捕捉复杂的模式和特征,从而在自然语言处理、计算机视觉等任务中取得突破性进展。DeepSeek作为一款基于Transformer架构的多模态大模型,专注于多模态任务和高性能推理,结合了自然语言处理和计算机视觉的优势,能够处理文本、图像、视频等多种数据类型。

DeepSeek的技术创新

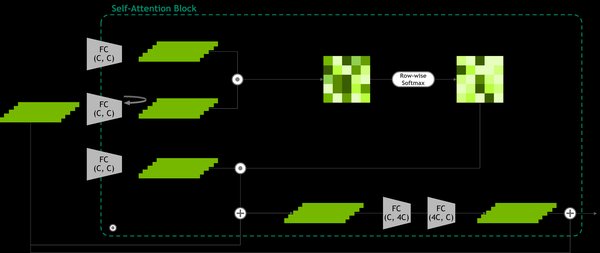

DeepSeek的核心架构基于Transformer,采用了多层自注意力机制和前馈神经网络。其主要特点包括:

- 多头注意力机制:能够并行处理多个注意力头,捕捉不同层次的语义信息。

- 位置编码:通过正弦和余弦函数为输入序列添加位置信息。

- 残差连接与层归一化:提高模型的训练稳定性和收敛速度。

此外,DeepSeek还引入了多项关键技术创新,如动态计算图、混合精度训练和多模态融合,进一步提升了模型的灵活性和效率。

开源与闭源之争

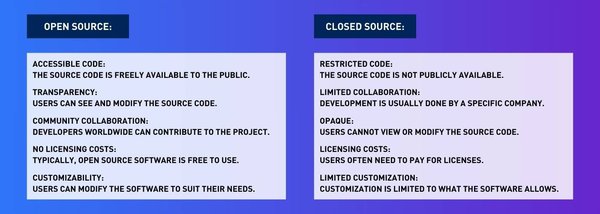

DeepSeek的“开源周”活动在全球AI领域引发了广泛关注,也激化了开源与闭源之争。开源模式通过公开源代码,允许任何人使用、修改和分发,极大地促进了技术的创新和共享。DeepSeek在“开源周”期间连续开源了五个代码库,涵盖训练、推理、通信等大模型开发的关键环节,吸引了全球开发者共同参与。

然而,闭源模式也有其独特的优势。闭源大模型由特定的组织或公司开发、拥有并维护其源代码、数据集和技术细节,能够保护知识产权和商业利益。OpenAI通过闭源模式,打造了如GPT系列这样的领先模型,并通过商业合作、API授权等方式,实现了巨大的商业成功。

商业与技术的博弈

DeepSeek的开源策略对行业内的巨头们产生了深远影响。百度作为国内AI领域的重要力量,此前一直是闭源路线的坚定支持者。然而,DeepSeek的成功迫使百度重新审视其策略,宣布将开源文心大模型系列。OpenAI也受到了冲击,其首席执行官山姆·奥特曼罕见承认过去在开源方面“站在历史错误的一边”,并表示将考虑开源较旧的AI模型。

多模态大模型的未来展望

多模态大模型在智能助手、医疗诊断、教育等多个领域展现出广阔的应用前景。然而,其发展也面临着计算资源需求、数据隐私与安全等挑战。未来,开源与闭源模式可能会继续共存,企业将根据自身需求选择合适的策略。

总结

DeepSeek的开源策略不仅推动了多模态大模型的技术创新,也引发了开源与闭源之间的激烈争论。无论是开源还是闭源,其最终目标都是推动大模型技术的进步和应用落地。随着人工智能技术的不断发展,多模态大模型将在更多领域发挥重要作用,引领未来科技的新潮流。

| 技术特点 | 开源模式优势 | 闭源模式优势 |

|---|---|---|

| 动态计算图 | 促进技术共享与创新 | 保护知识产权 |

| 混合精度训练 | 吸引全球开发者参与 | 实现商业变现 |

| 多模态融合 | 形成繁荣的生态系统 | 保证技术安全与稳定 |

通过深入探讨DeepSeek的技术创新及其开源策略,我们可以看到多模态大模型在推动人工智能发展中的重要作用。无论是开源还是闭源,其最终目标都是推动技术的进步和应用落地,为人类带来更多的便利和创新。