2024年3月13日,欧洲议会以压倒性多数通过了《人工智能法案》(Artificial Intelligence Act),标志着全球首个全面监管人工智能的法律框架正式诞生。这一法案不仅对欧盟内部的人工智能产业产生深远影响,也为全球AI监管树立了新的标杆。

法案的核心内容

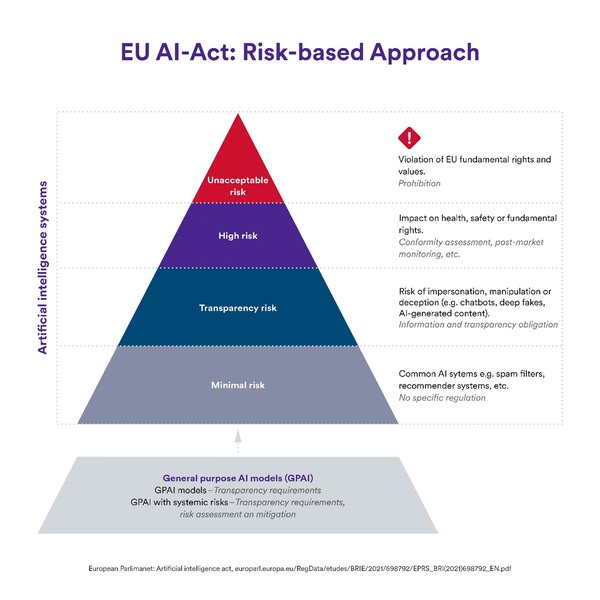

《人工智能法案》旨在建立一套统一的规范和监管框架,以确保人工智能技术的发展和应用能够遵循公平、透明和可信的原则。法案特别关注生成式AI工具如ChatGPT和谷歌Bard,提出了基于风险的监管方法。

-

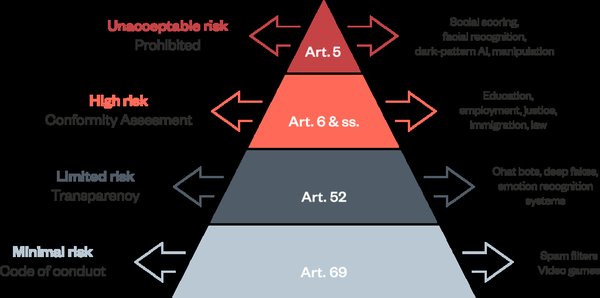

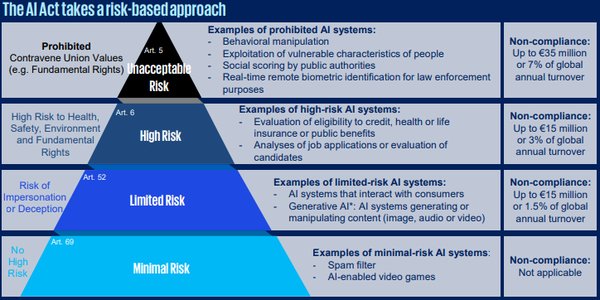

风险分类:法案将人工智能应用分为“不可接受”风险、高风险、中风险和低风险四类。被认定为带有“不可接受”风险的应用将被完全禁止。

-

透明度义务:通用目的人工智能系统(GPAI)及其所基于的GPAI模型必须满足透明度要求,包括遵守欧盟著作权法和发布用于培训的内容的详细摘要。

-

处罚措施:违反规则的公司可能面临高达全球营业额7%的罚款,这一严厉的处罚措施引发了大型科技公司的担忧。

对生成式AI的特别监管

生成式AI工具如ChatGPT在法案中受到特别关注。法案要求这些工具在上市前必须遵守透明度义务,包括拟定技术文件、遵守欧盟版权法以及传播有关培训内容的详细摘要。对于具有系统性风险的高影响力基础模型,法案还要求进行模型评估、评估和减轻系统性风险、进行对抗性测试,并向欧盟委员会报告严重事件。

欧盟的全球领导地位

欧盟内部市场专员蒂埃里·布雷顿(Thierry Breton)在社交媒体上表示:“欧洲现在是人工智能的全球标准制定者。”这一法案的通过不仅确立了欧盟在AI监管领域的领导地位,也为全球其他国家和地区提供了借鉴。

挑战与争议

尽管法案获得了广泛支持,但也引发了一些争议。一些欧盟成员国和大型企业担心过度监管可能会扼杀创新,阻碍欧洲在科技领域与中国和美国公司竞争的进程。法国、德国和意大利的谈判代表曾建议效仿美国的监管方法,反对直接监管生成型人工智能基础大模型,而是支持其背后的公司通过政府引入的行为准则进行自我监管。

未来展望

《人工智能法案》预计将在今年5月生效,并分阶段施行。欧盟希望通过这一法案保持其在全球AI竞赛中的领先地位,并确保AI技术的发展符合欧盟的价值观和基本权利。对于可能或已经在欧盟地区开展相关业务的中国人工智能企业,以及关注国内人工智能产业治理和监管的部门,这部新法也值得给予高度重视。

欧盟《人工智能法案》的通过不仅是全球AI监管的重要里程碑,也为未来AI技术的发展和应用设定了新的标准。