随着ChatGPT和GPT-4等AI模型的快速发展,AI生成决策(AIGA)和多智能体系统逐渐成为人工智能领域的热点话题。这些技术不仅在语言和对话生成方面表现出色,还在系统性决策中展现出巨大潜力。然而,其发展也伴随着诸多挑战和争议。

AI决策生成的进展与挑战

OpenAI首席执行官Sam Altman曾公开表示对AI强大能力的担忧。他指出,尽管AI在生成文本、图像和对话方面取得了显著进展,但其在复杂决策场景中的应用仍需谨慎对待。伦敦大学学院教授汪军也在近期的一次演讲中提到,ChatGPT虽然在语言生成方面表现出色,但在系统性决策方面仍存在不足。

汪军教授强调了多智能体决策大模型的发展潜力。他认为,通过强化学习等技术,AI可以在多任务处理中实现更高效的决策生成。例如,DeepMind的GATO模型已经在多任务处理中展现出显著优势,能够同时处理语言、图像和决策任务。

多智能体系统的未来

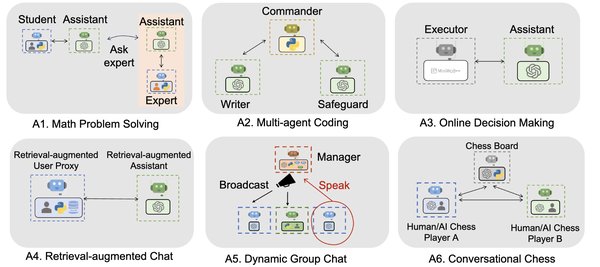

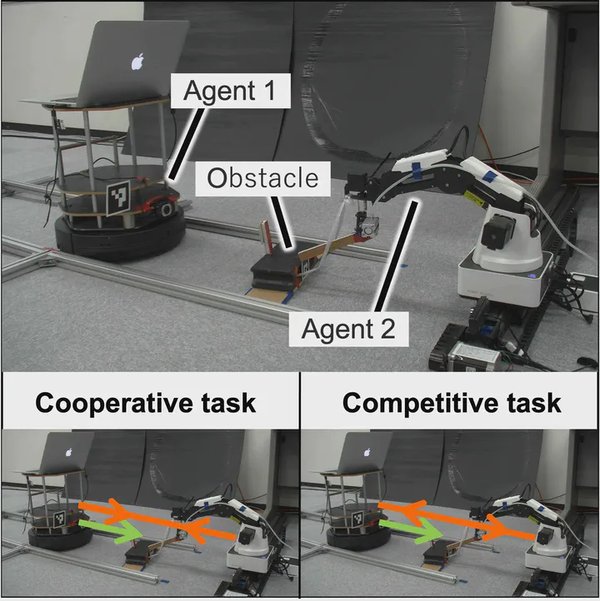

多智能体系统是指由多个AI智能体协同工作的系统,这些智能体可以独立或合作完成复杂任务。在多智能体系统中,决策生成不仅需要考虑单个智能体的能力,还需要协调多个智能体之间的互动。

汪军教授指出,多智能体系统的成功依赖于强化学习等技术的支持。通过强化学习,智能体可以在不断试错中优化决策策略,从而在多任务处理中实现更高的效率和准确性。

行业应用与伦理考量

在行业应用中,AI决策生成和多智能体系统已经开始发挥重要作用。例如,Infosys最近推出的“负责任AI工具包”就是一个典型例子。该工具包旨在帮助企业应对AI决策中的伦理风险,包括隐私泄露、偏见输出和恶意使用等问题。

然而,随着AI决策生成技术的普及,伦理问题也日益凸显。如何在确保AI高效决策的同时,避免其对社会产生负面影响,是业界亟需解决的问题。

结语

AI决策生成和多智能体系统的未来发展充满机遇与挑战。通过强化学习等技术,AI在复杂决策场景中的应用将更加广泛。然而,如何在技术创新的同时,确保其伦理性和安全性,仍需业界共同努力。

在AIGA时代,AI不仅需要“聪明”,更需要“负责任”。只有通过多方协作和技术创新,我们才能充分发挥AI的潜力,为人类社会带来更多福祉。