生成式AI的“幻觉”问题:挑战与现状

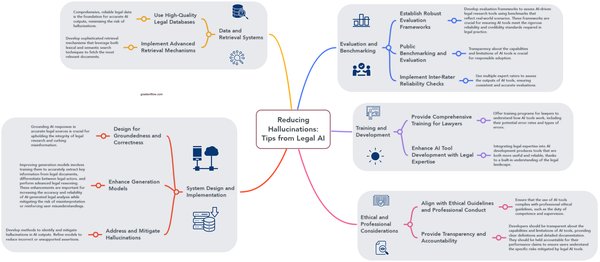

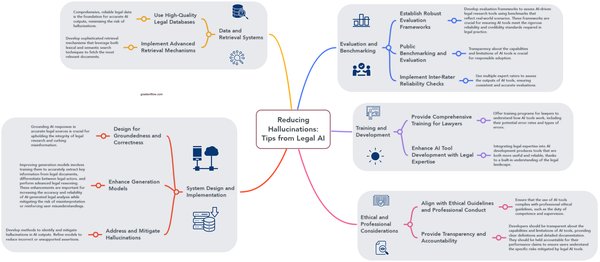

OpenAI最新推出的生成式AI模型o1在复杂推理和数学领域展现出了令人瞩目的能力。o1在回答问题时能够进行深度思考,并在多项基准测试中表现媲美人类专家。然而,尽管其在技术层面取得了显著进展,o1仍未完全解决生成式AI的“幻觉”问题,即模型在生成内容时可能产生不准确或虚构的信息。

这一现象不仅影响了AI的可靠性,也对用户信任构成了挑战。OpenAI在新模型中加强了安全性和与人类价值观的对齐,但幻觉问题依然是技术发展的瓶颈。

AI在教育中的应用潜力与风险

生成式AI在教育领域的应用前景广阔。研究表明,AI可以作为“AI导师”与学生进行互动,帮助他们深入理解课程内容。这种个性化辅导模式甚至有望解决著名的“2 sigma”问题,即接受个人辅导的学生在学术表现上显著优于传统课堂学习的学生。

然而,教育场景中的AI应用也面临挑战。例如,研究指出,过度拟人化的学习材料可能会增加学生的认知负担,而并未带来显著的学习效果提升。这表明,AI在教育中的设计需要更加注重实用性与有效性,而非单纯追求拟人化效果。

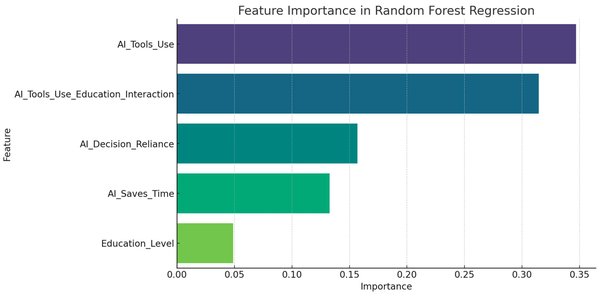

批判性思维的重塑与AI的依赖

随着AI的普及,人类批判性思维的模式正在悄然改变。研究显示,频繁使用AI可能导致用户对技术的依赖,从而削弱其独立思考和判断能力。这一现象在教育、科研等领域尤为明显,因为AI的便利性可能诱使用户减少对信息的深度分析和验证。

这种依赖不仅影响个人的认知能力,还可能对社会的整体创新能力产生深远影响。因此,如何在利用AI提升效率的同时,保持和培养人类的批判性思维,成为了亟待解决的问题。

未来展望:技术与人类价值观的平衡

生成式AI的发展为各行各业带来了前所未有的机遇,但同时也伴随着风险和挑战。OpenAI在o1模型中强调安全性和与人类价值观的对齐,体现了技术开发者对伦理问题的重视。然而,幻觉问题的解决仍需更多技术突破和跨学科合作。

未来,AI的应用不仅需要技术上的创新,还需要在伦理、教育和社会层面进行深度思考。通过平衡技术进步与人类价值观,我们才能真正释放生成式AI的潜力,为人类社会创造更多价值。