在人工智能领域,自然语言处理(NLP)一直是一个充满挑战的研究方向。随着深度学习技术的发展,BERT(Bidirectional Encoder Representations from Transformers)模型的出现,彻底改变了这一领域的格局。本文将深入探讨BERT模型的核心技术、发展历程以及未来的应用前景。

BERT的核心技术

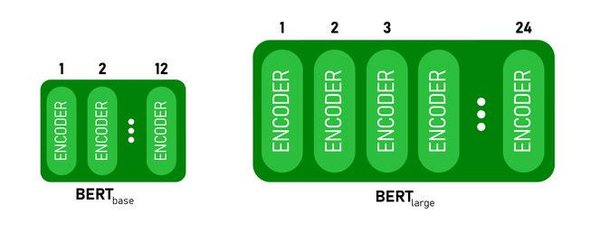

BERT模型基于Transformer架构,其核心创新在于双向上下文理解。与传统的单向语言模型不同,BERT能够同时考虑一个词的左右上下文,从而更准确地理解语言的含义。以下是BERT的主要技术特点:

-

双向Transformer编码器:BERT使用双向Transformer编码器来捕捉文本中的上下文信息。

-

Masked Language Model (MLM):通过随机遮盖输入文本中的部分单词,BERT训练模型预测被遮盖的单词,从而学习到更丰富的语言表示。

-

Next Sentence Prediction (NSP):BERT还通过预测两个句子是否连续,来学习句子之间的关系。

BERT的发展历程

BERT模型由Google在2018年提出,迅速成为NLP领域的标杆。以下是BERT发展历程中的几个关键节点:

-

Transformer架构的提出:2017年,Google Brain团队提出Transformer模型,为BERT的诞生奠定了基础。

-

BERT的发布:2018年,Google发布BERT模型,其在多项NLP任务中取得了最先进的性能。

-

后续改进:基于BERT,Google又推出了T5模型,进一步扩展了Transformer的应用范围。

BERT的应用前景

BERT模型在文本理解和生成任务中表现出色,以下是其未来可能的应用方向:

-

智能客服:通过理解用户的语言,提供更精准的回复。

-

信息检索:提高搜索引擎的准确性和效率。

-

机器翻译:实现更流畅、准确的翻译效果。

-

文本摘要:自动生成高质量的文本摘要。

结语

BERT模型作为自然语言处理领域的革命性突破,不仅推动了人工智能技术的发展,也为未来的应用提供了无限可能。随着技术的不断进步,BERT及其衍生模型将继续在文本理解、生成和对话系统等领域发挥重要作用。

通过本文的介绍,相信读者对BERT模型有了更深入的了解。未来,随着技术的不断演进,BERT及其衍生模型将在更多领域展现其强大的能力。