Migician:多模态模型的新标杆

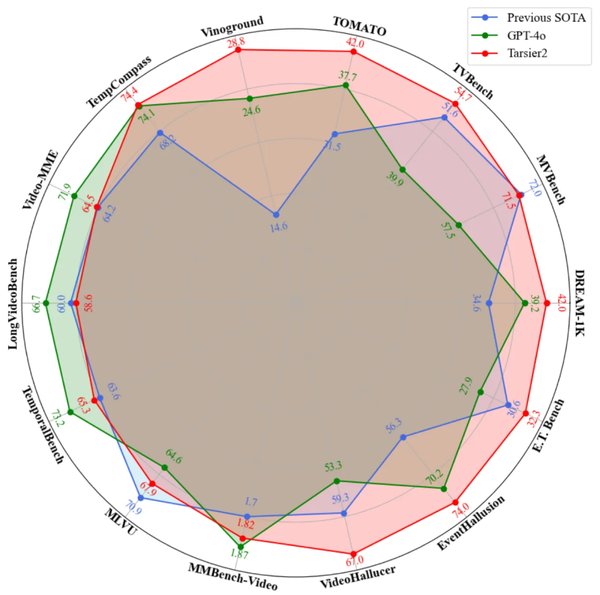

近日,清华团队推出了一款名为Migician的多模态模型,该模型在MIG-Bench测试中表现优异,平均性能提升了24.94%,成为多图定位任务的新标杆。Migician的推出,不仅展示了清华团队在人工智能领域的深厚实力,也为多模态模型的发展开辟了新的方向。

多图定位任务的突破

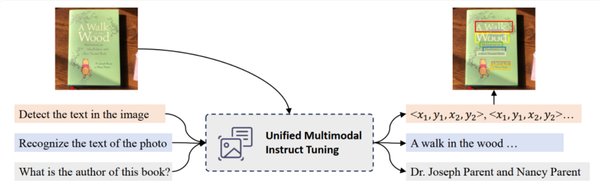

Migician模型的最大亮点在于其支持任意形式的多图定位任务。传统的多模态模型在处理多图定位时,往往需要遵循特定的语法模板,限制了其灵活性和自然性。而Migician通过指令调优训练,能够直接在多图像场景中进行端到端的定位任务,无需特定的语法模板,实现了更灵活自然的语言交互。

文本指令与图像理解的完美结合

Migician模型擅长将文本指令与图像理解结合,能够在多张图片中精准定位物体。例如,在定位某个特定房间内的物品时,模型会先根据文本描述判断该房间可能所在的区域,再在该区域内的图像中精确定位物品。这种逐步推导的方式,不仅提高了定位的准确性,也增强了模型的实用性。

CoT推理优化的应用

Migician模型的成功,离不开CoT(Chain-of-Thought)推理优化的应用。CoT推理优化将复杂问题分解为多个简单子问题,逐步推导得出最终答案。这种方法不仅提高了模型的推理能力,也使得模型在处理复杂任务时更加高效和准确。

未来展望

Migician模型的推出,标志着多模态模型在多图定位任务上迈出了重要的一步。未来,随着技术的不断进步,Migician有望在更多领域发挥其优势,为人工智能的发展带来更多可能性。清华团队的这一创新成果,无疑将引领多模态模型的新潮流,推动人工智能技术的进一步发展。

通过Migician模型,我们看到了多模态模型在多图定位任务中的巨大潜力。清华团队的这一创新,不仅提升了模型的性能,也为未来的技术发展提供了新的思路和方向。Migician的成功,预示着多模态模型将在未来的智能应用中扮演越来越重要的角色。