多模态大模型的崛起

随着人工智能技术的不断进步,多模态大模型(Multimodal Large Models)正逐渐成为AI领域的新焦点。这类模型能够处理和理解多种类型的数据,如文字、图像和声音,从而提供更加丰富和深入的用户体验。OpenAI的最新模型GPT-4.5就是一个典型的例子,它不仅在自然语言处理上表现出色,还能处理图像和文件上传,展示了多模态学习的强大潜力。

GPT-4.5的特点与优势

GPT-4.5是OpenAI在2024年推出的新一代AI模型,它在多个方面进行了显著改进:

-

知识广度:GPT-4.5学习了更多的信息,使其在回答复杂问题时更加准确。

-

减少幻觉:通过优化算法,GPT-4.5减少了AI编造事实的情况,提高了信息的可靠性。

-

情感理解:模型在理解用户情感和意图方面更加精准,使得对话更加自然和人性化。

-

创意表达:在写作和设计等创意领域,GPT-4.5的表现更加出色,能够生成更加丰富和有创意的内容。

多模态学习的应用

多模态大模型的应用范围广泛,从教育到娱乐,再到专业服务,都有着巨大的潜力。例如,GPT-4.5能够处理图像和文件上传,这使得它在教育领域可以用于自动批改作业,在娱乐领域可以用于生成更加逼真的虚拟现实体验。此外,结合语音识别技术,GPT-4.5还能在客服和语音助手等领域提供更加高效和自然的服务。

AI推理与情感理解的未来

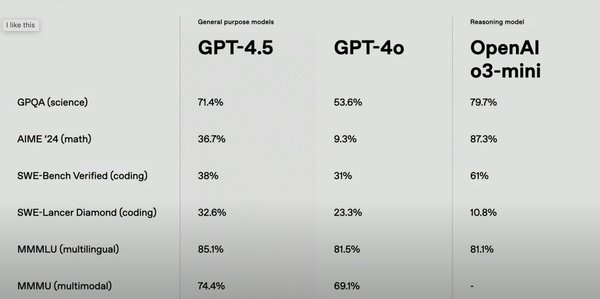

尽管GPT-4.5在多模态学习上取得了显著进展,但它在推理能力上仍有待提升。OpenAI的o1系列模型则专注于推理能力,能够在处理复杂任务时进行更深层次的思考。未来,随着AI技术的进一步发展,我们可以期待看到更多结合了多模态学习和深度推理的AI模型,这些模型将能够更好地理解和模拟人类的思维过程,从而在各种应用场景中提供更加精准和高效的服务。

结论

多模态大模型代表了人工智能技术的下一个前沿,它们通过整合多种数据类型,提供了更加丰富和深入的用户体验。GPT-4.5的推出展示了多模态学习的强大潜力,而o1系列模型则在推理能力上进行了深入探索。随着技术的不断进步,我们可以期待看到更多创新和突破,这些将极大地推动AI技术的发展和应用。