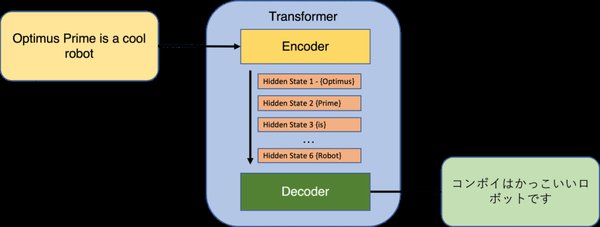

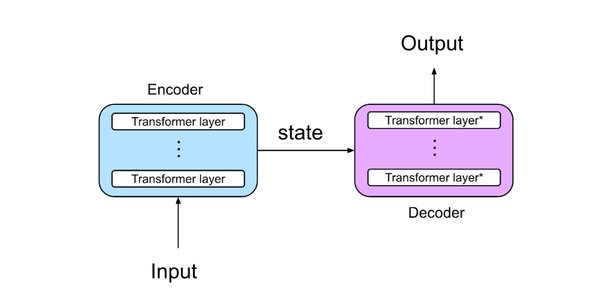

Transformer模型:AI领域的革命性突破

Transformer模型自问世以来,迅速成为AI领域的核心技术之一。其强大的自注意力机制和并行处理能力,使其在自然语言处理、计算机视觉等多个领域取得了显著成果。香港中文大学汤晓鸥教授在世界人工智能大会上的演讲,进一步凸显了Transformer模型在AI技术发展中的重要性。

多模态LLMs在时间序列异常检测中的应用

多模态大型语言模型(MLLMs)在时间序列分析中的应用逐渐受到关注。研究表明,MLLMs在时间序列异常检测(TSAD)中表现出色,特别是在检测范围和变量异常方面。通过将时间序列数据转换为图像格式,MLLMs能够有效识别异常点,并在不规则时间序列中表现出高度的鲁棒性。这一发现为时间序列分析提供了新的视角和方法。

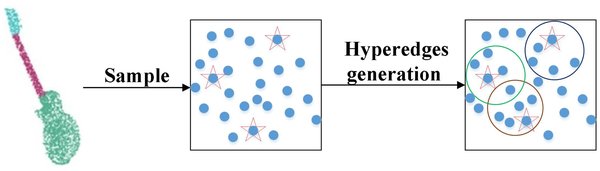

超图在骨架动作识别中的优势

超图作为一种高阶关系建模工具,在骨架动作识别中展现出显著优势。与传统的图模型相比,超图能够捕捉多个关节之间的复杂关系,从而更准确地识别动作。例如,在“挥手”动作中,超图能够同时考虑肩部、肘部和腕部的运动,提高识别的准确性。此外,超图在多尺度信息融合和动态调整关节重要性方面表现出色,使其在复杂动作识别中具有广泛应用前景。

汤晓鸥教授及其学生的杰出贡献

汤晓鸥教授在演讲中分享了其三位学生王晓刚、何恺明和林达华在AI领域的贡献。王晓刚在深度学习初期的ImageNet竞赛中夺冠,为深度学习的发展奠定了基础。何恺明提出的ResNet和Mask R-CNN等技术,极大地推动了计算机视觉领域的进步。林达华通过OpenMMLab开源项目和发布大模型书生·浦语及LandMark天际,为AI技术的发展做出了重要贡献。新一代学生在自动驾驶大模型领域的突破,进一步展示了Transformer技术在未来的潜力。

未来展望

随着Transformer技术的不断发展,其在AI领域的应用将更加广泛。多模态LLMs和超图等新兴技术的结合,将为时间序列分析和骨架动作识别等领域带来更多创新。汤晓鸥教授及其学生的杰出贡献,为AI技术的发展提供了坚实的理论基础和实践经验。未来,Transformer技术有望在更多领域实现突破,推动AI技术的进一步发展。