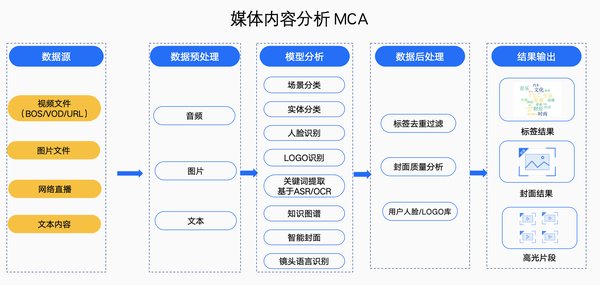

引言:AI视频生成的新里程碑

随着人工智能技术的飞速发展,视频生成领域迎来了新的突破。阿里巴巴通义实验室近日开源的Wan2.1系列模型,凭借其强大的技术架构和创新的设计理念,为AI视频生成技术树立了新的标杆。本文将深入探讨Wan2.1的核心技术及其在视频生成领域的应用价值。

Wan2.1的核心技术创新

Wan2.1系列模型在视频生成领域的突破性进展,主要得益于以下几大核心技术:

3D变分自编码器(VAE):视频压缩与质量的完美平衡

Wan2.1团队创新性地提出了3D因果VAE架构,专为视频生成量身打造。该架构在时空压缩、内存控制和时间因果性之间找到了最佳平衡点,使得VAE更高效、更易扩展,并与扩散模型DiT完美结合。

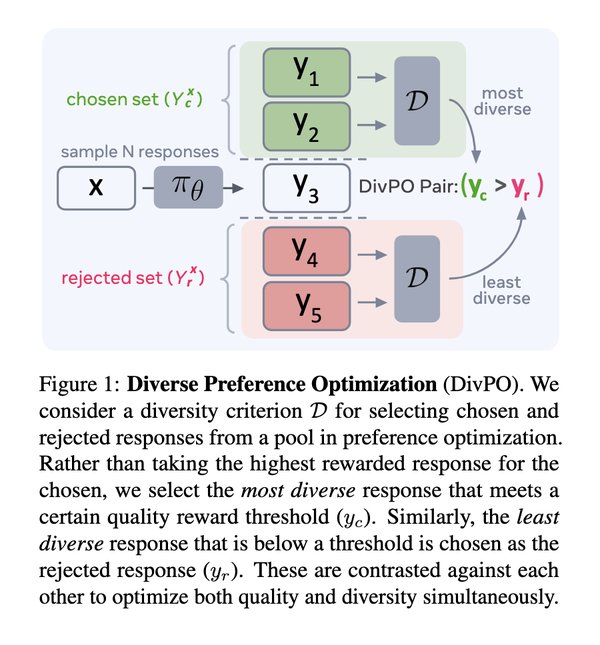

视频扩散DiT:强大生成力的源泉

Wan2.1基于主流扩散Transformer范式和Flow Matching框架构建了视频扩散模型DiT。通过T5 Encoder编码多语言文本,并在每个Transformer Block中加入交叉注意力,将文本信息深度融入模型结构。

模型扩展与训练效率优化

为了训练更大规模的Wan2.1模型,并提升训练和推理效率,团队采用了多种并行策略,包括FSDP(Fully Sharded Data Parallel)和上下文并行(CP),实现了近乎线性的加速。

Wan2.1的多样化应用场景

Wan2.1系列模型家族为不同需求的用户提供了多样化的选择,包括:

-

Wan2.1-I2V-14B:图像到视频(I2V)领域的天花板,140亿参数,720P高清画质。

-

Wan2.1-T2V-14B:文字到视频(T2V)领域的性能王者,140亿参数,720P高清画质,独家支持中英文文字生成。

-

Wan2.1-T2V-1.3B:消费级显卡的最佳拍档,13亿参数,480P流畅运行,8GB视频内存即可畅玩。

未来展望:AI视频生成的新篇章

Wan2.1的开源标志着AI视频生成技术进入了一个新的阶段。随着技术的不断进步,未来视频生成将更加智能化、高效化,为影视制作、广告创意、教育等领域带来更多可能性。阿里巴巴通义实验室的这一创新,无疑为AI视频生成领域注入了新的活力。

结语

Wan2.1系列模型的开源,不仅展示了阿里巴巴在AI技术领域的深厚积累,也为全球AI社区提供了强大的工具和资源。期待未来更多创新技术的涌现,共同推动人工智能技术的进步与发展。