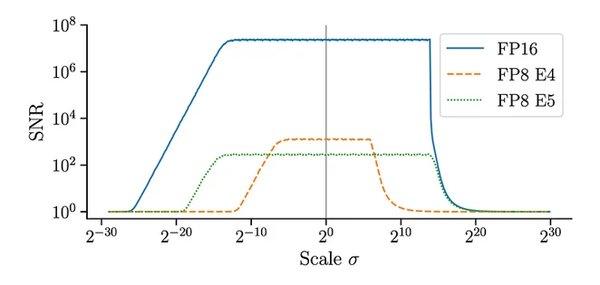

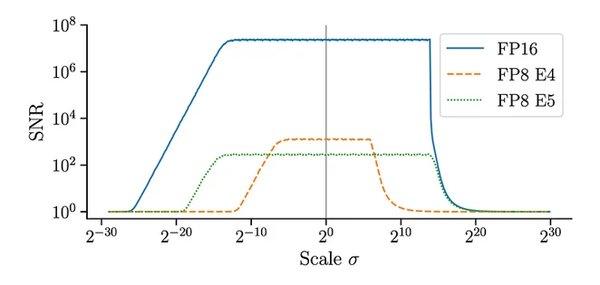

FP8混合精度训练的优势

FP8混合精度训练通过使用更低精度的数据格式,显著提高了深度学习模型的训练速度和效率。以下是FP8混合精度训练的主要优势:

-

提高训练速度:FP8数据格式的计算速度更快,所需内存更少,从而加速了模型的前向和反向传播过程。例如,在H800 GPU上进行LLaMA2-7B模型训练时,使用FP8混合精度训练相比BF16可以实现35%的吞吐量提升。

-

减少内存占用:FP8数据格式占用的内存仅为FP32的一半,这使得模型在训练过程中能够更高效地利用硬件资源,允许训练更大的模型或在单个GPU上处理更多的数据样本。

-

降低能耗与成本:FP8混合精度训练通过减少计算量和提高硬件资源利用效率,显著降低了能源消耗,从而降低了大规模深度学习训练的成本。

-

提升模型泛化能力:FP8较低的精度在一定程度上会引入一些计算噪声,这种噪声可以起到类似数据增强或正则化的作用,有助于模型学习到更鲁棒的特征表示,从而提高模型的泛化能力。

硬件支持与实现

FP8混合精度训练依赖于硬件的特定支持。目前,许多现代GPU如NVIDIA的Hopper系列芯片(H100, H200, H800等)支持FP8计算,并对FP8数据类型有优化。然而,并非所有的硬件平台都提供这样的支持,特别是在一些入门级或旧设备上可能不具备浮点数混合精度的能力。

在实现方面,一些框架和工具(如Colossal-AI)提供了对FP8混合精度训练的广泛支持,使得开发者可以通过简单的代码配置启用FP8训练。例如,仅需在初始化plugin时开启FP8即可。

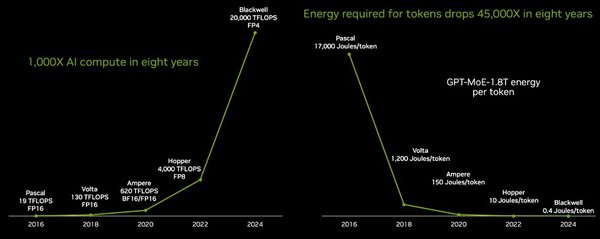

FP8在AI算力革命中的关键作用

FP8混合精度训练在AI算力革命中扮演着关键角色。它不仅提高了训练速度和效率,还降低了内存占用和能耗,为大规模深度学习模型的训练提供了显著的性能提升和成本节约。此外,FP8的引入还推动了硬件技术的发展,促使更多的硬件平台支持这一先进技术。

在实际应用中,FP8混合精度训练已经在H800 GPU集群上进行了实测,性能大幅提升。这表明FP8不仅是一种理论上的优化技术,更是一种在实际应用中能够带来显著效益的解决方案。

结论

FP8混合精度训练通过提高训练速度、减少内存占用、降低能耗与成本、提升模型泛化能力等多方面的优势,为大规模深度学习模型的训练提供了显著的性能提升和成本节约。然而,它也对硬件支持提出了更高要求,并需要开发者在实现时注意数值稳定性和收敛性问题。随着FP8技术的不断发展和普及,我们有理由相信,它将在未来的AI算力革命中发挥越来越重要的作用。