深度造假图像的技术挑战

深度造假(Deepfake)技术近年来迅速发展,成为网络信息安全的重大威胁。通过生成式AI,不法分子可以轻易伪造名人、政要甚至普通人的图像和视频,造成社会混乱和信任危机。以近期泰勒·斯威夫特的AI不雅照事件为例,深度造假图像在社交媒体上迅速传播,不仅侵犯了个人隐私,也引发了公众对AI技术滥用的担忧。

深度造假技术的核心在于生成式AI模型,如GPT和Sora等。这些模型通过海量数据训练,能够生成逼真的图像和视频。然而,技术的双刃剑效应也在此显现:一方面,生成式AI为创意产业和科学研究提供了巨大潜力;另一方面,它也为不法分子提供了伪造工具。

治理深度造假的现有对策

面对深度造假带来的挑战,全球各国正在积极推动相关立法和技术治理措施。美国、欧洲和中国都在制定或完善相关法律法规,以应对生成式AI的潜在风险。例如,欧盟的《人工智能法案》对AI系统的透明度、风险评估和数据保护提出了严格要求,为全球治理提供了参考。

在技术层面,谷歌等科技公司也在探索应对深度造假的方法。谷歌推出的“이마젠 3”工具配备了一系列安全措施,包括数字水印和禁止生成特定名人图像的功能,以防止深度伪造的滥用。此外,通过红队评估和广泛的数据标注,谷歌努力降低有害内容输出的可能性。

生成式AI:打击深度造假的关键

尽管深度造假技术带来了挑战,但生成式AI本身也是解决这一问题的重要手段。通过AI识别和删除侵权图片,平台可以快速应对伪造内容的传播。例如,TikTok等社交媒体平台已经采用了AI技术,自动检测并移除虚假信息,维护平台的信息生态。

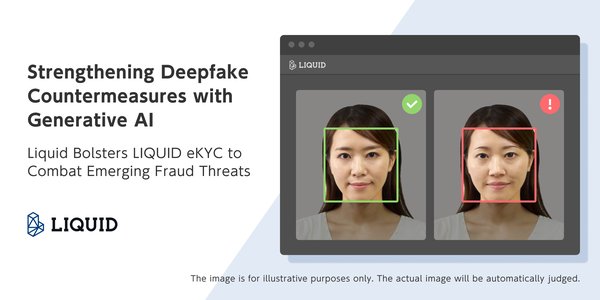

此外,生成式AI还可以用于开发更先进的检测工具。通过训练模型识别伪造图像的细微特征,技术开发者能够提高检测的准确性和效率。这种“以技术对抗技术”的策略,被认为是应对深度造假问题的有效途径。

结语:技术发展与法律监管并重

深度造假图像的治理需要技术发展与法律监管的双重努力。一方面,应鼓励生成式AI技术的创新,提升其检测和打击伪造内容的能力;另一方面,需通过立法明确责任边界,防止技术滥用。只有技术与法律并重,才能有效应对深度造假带来的挑战,构建安全可信的网络环境。

展望未来,随着生成式AI技术的不断进步,深度造假的治理也将迎来新的机遇与挑战。全球各界需携手合作,共同推动技术向善,为网络空间的健康发展保驾护航。