引言

随着人工智能(AI)技术的快速发展,算力需求呈现爆发式增长。高带宽内存(HBM)作为AI算力的核心组件,正成为全球半导体市场竞争的焦点。本文将深入探讨HBM存储技术的现状、竞争格局及其对AI算力革命的影响。

HBM技术的核心优势

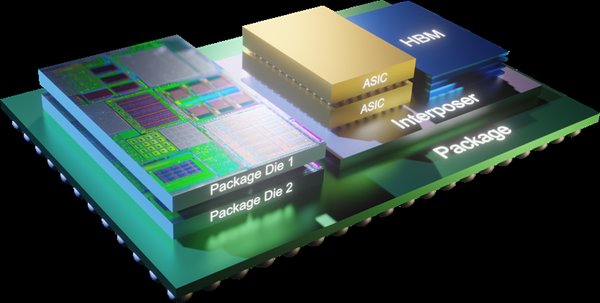

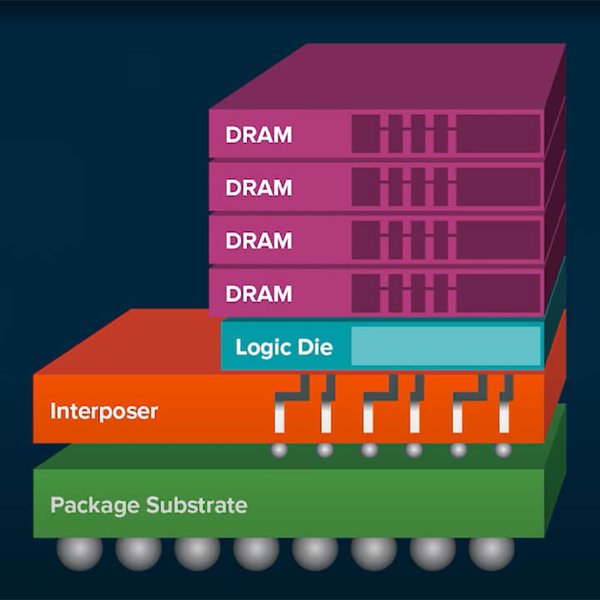

HBM(High Bandwidth Memory)是一种高带宽、高密度的存储技术,专为高性能计算(HPC)和AI应用设计。其核心优势包括:

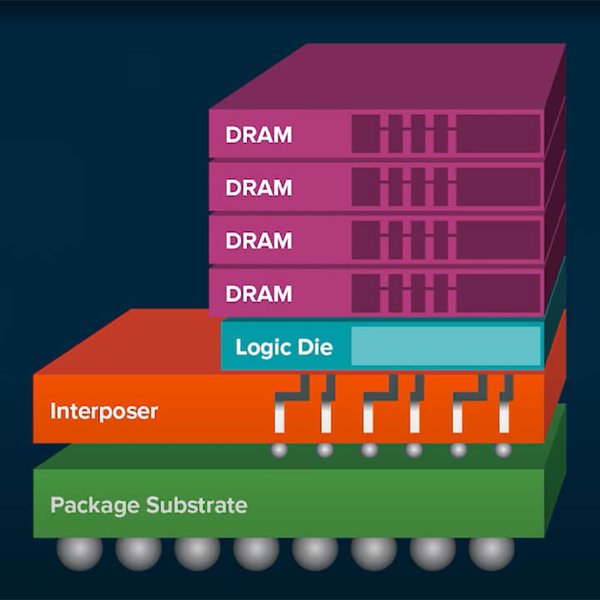

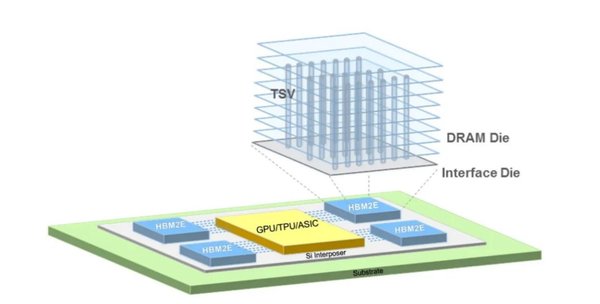

– 高带宽:HBM通过3D堆叠技术实现极高的数据传输速率,满足AI模型对数据吞吐量的需求。

– 低功耗:相比传统DRAM,HBM在相同带宽下功耗更低,适合大规模部署。

– 紧凑设计:HBM与处理器紧密集成,减少信号延迟,提升整体性能。

市场竞争格局

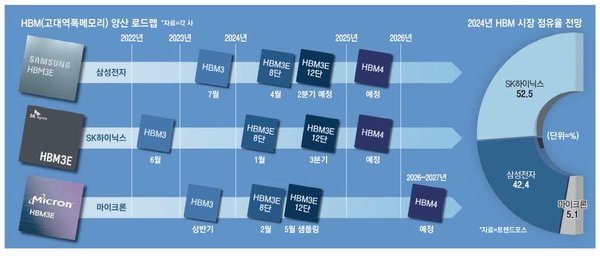

HBM市场的竞争主要集中在美国的美光、韩国的SK海力士和三星电子之间。以下是各厂商的最新动态:

| 厂商 | 最新进展 | 市场地位 |

|---|---|---|

| 美光 | 量产12层HBM3E,计划2026年推出HBM4 | 快速崛起,追赶SK海力士 |

| SK海力士 | 主导HBM3E市场,计划2026年量产HBM4 | 市场领导者 |

| 三星电子 | 延迟第六代DRAM量产,HBM4计划面临不确定性 | 技术滞后,市场份额下降 |

美光的崛起

美光近年来在HBM领域取得了显著进展。其12层HBM3E芯片已开始量产,并计划在2026年推出HBM4。美光的HBM3E芯片在性能和功耗上均优于竞争对手,已获得英伟达等AI芯片巨头的订单。

SK海力士的领导地位

SK海力士凭借其在HBM3E市场的领先地位,继续巩固其市场主导地位。该公司计划在2026年量产HBM4,并已开始开发下一代HBM技术。

三星的困境

三星电子在HBM市场的表现相对滞后。其第六代DRAM量产计划延迟,导致HBM4的开发进度受到影响。三星正面临来自美光和SK海力士的激烈竞争,市场份额逐渐下降。

HBM对AI算力的革命性影响

HBM技术的高带宽和低功耗特性,使其成为AI算力的关键推动力。以下是HBM对AI算力的主要影响:

– 提升模型训练效率:HBM的高带宽显著加速了大规模AI模型的训练过程,减少了训练时间。

– 降低能耗成本:HBM的低功耗特性降低了数据中心的能耗成本,适合大规模部署。

– 支持复杂AI应用:HBM的高密度设计支持更复杂的AI应用,如自动驾驶和医疗诊断。

未来趋势与展望

随着AI技术的不断发展,HBM市场将迎来更多创新和竞争。以下是未来HBM技术的几大趋势:

– 更高堆叠层数:未来HBM芯片将采用更多堆叠层数,进一步提升带宽和容量。

– 更先进制程:采用更先进的制程技术,如EUV光刻,以提高芯片性能和良率。

– 3D DRAM架构:未来HBM技术可能向3D DRAM架构发展,进一步突破存储密度和性能极限。

结论

HBM存储技术正在推动AI算力的革命性发展,成为全球半导体市场竞争的焦点。美光、SK海力士和三星在HBM领域的竞争,将决定未来AI算力的发展方向。随着技术的不断进步,HBM有望在AI时代发挥更加重要的作用,推动全球半导体市场的创新与变革。

通过本文的分析,我们可以看到,HBM技术不仅是AI算力的核心,更是全球半导体市场竞争的关键。未来,随着技术的不断突破,HBM将继续引领AI算力的革命,为全球科技发展注入新的活力。