引言

近年来,Transformer模型在自然语言处理(NLP)领域取得了显著进展,成为构建AI智能体的核心技术之一。本文将详细探讨Transformer模型在AI智能体开发中的应用与优化,并结合实际案例,为开发者提供实用的指导。

开发AI智能体的一般步骤

需求分析

在开发AI智能体之前,首先需要进行详细的需求分析,明确智能体的功能和应用场景。例如,在积石山地震后的滑坡监测中,需求分析包括快速识别滑坡区域和动态监测形变。

数据收集与准备

数据是AI智能体开发的基础。在积石山地震案例中,研究人员使用了2017年3月至2023年12月的升轨与降轨Sentinel-1影像,通过InSAR技术反演获得相位梯度速率和年平均形变速率。

算法选择与框架

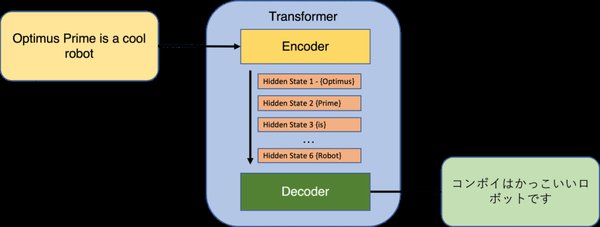

Transformer模型因其强大的序列建模能力,成为NLP任务的首选算法。在AI智能体开发中,可以选择BERT、GPT-4等预训练模型,或根据具体需求定制Transformer架构。

模型开发

在模型开发阶段,需要将Transformer模型与具体任务结合。例如,在积石山地震研究中,研究人员采用了DeepLabv3深度学习滑坡自动化识别方法,快速绘制活动滑坡编目图。

集成智能体逻辑

将模型集成到智能体逻辑中,确保智能体能够根据输入数据做出合理的决策。在滑坡监测中,智能体需要根据InSAR数据动态调整监测策略。

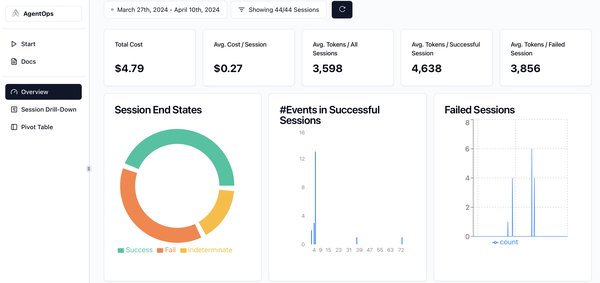

部署与测试

部署智能体后,需要进行全面测试,确保其在实际应用中的稳定性和准确性。在积石山地震案例中,现场调查验证了动态形变监测结果的可靠性。

优化与迭代

根据测试结果,对智能体进行优化和迭代。例如,研究人员通过序贯InSAR技术实现了新获得的合成孔径雷达影像的快速处理,及时捕获滑坡形变加速信号。

Transformer模型在AI智能体中的具体应用

自然语言处理

Transformer模型在NLP任务中表现出色,如文本分类、机器翻译和问答系统。在AI智能体中,可以利用Transformer模型处理用户输入的自然语言指令。

图像识别

虽然Transformer最初是为NLP设计的,但其在图像识别任务中也取得了显著进展。例如,Vision Transformer(ViT)在图像分类任务中表现优异。

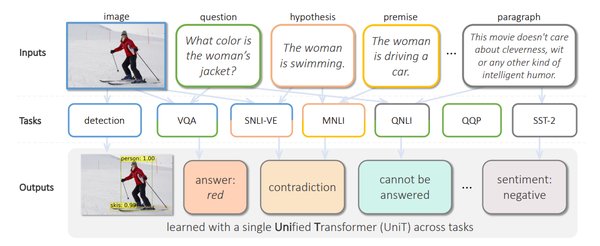

多模态融合

Transformer模型可以处理多模态数据,如文本、图像和音频。在AI智能体中,可以利用多模态Transformer模型实现更复杂的任务,如视频内容分析。

技术动态与案例分析

最新技术动态

近期,美国人工智能初创企业Reflection AI宣布完成1.3亿美元的融资,显示出Transformer模型在AI领域的巨大潜力。

实际案例

在积石山地震研究中,研究人员利用Transformer模型和InSAR技术,成功识别了2,021个潜在活动滑坡,并动态监测了滑坡形变。这一案例展示了Transformer模型在实际应用中的高效性和可靠性。

结论

Transformer模型在AI智能体开发中具有广泛的应用前景。通过详细的需求分析、数据准备、模型开发和优化,开发者可以构建出高效、智能的AI智能体。未来,随着技术的不断进步,Transformer模型将在更多领域发挥重要作用。

表格:Transformer模型在AI智能体开发中的应用场景

| 应用场景 | 具体任务 | 使用的Transformer模型 |

|---|---|---|

| 自然语言处理 | 文本分类、机器翻译、问答系统 | BERT, GPT-4 |

| 图像识别 | 图像分类、目标检测 | Vision Transformer |

| 多模态融合 | 视频内容分析、多模态问答 | Multimodal Transformer |

通过以上内容,我们可以看到Transformer模型在AI智能体开发中的广泛应用和巨大潜力。希望本文能为开发者提供实用的指导,推动AI智能体技术的进一步发展。