引言

随着大语言模型(LLM)在各行各业的广泛应用,如何高效地微调这些模型以适应特定任务成为了一个关键问题。传统的微调方法需要大量的计算资源和时间,而LoRA(Low-Rank Adaptation)技术的出现,为这一难题提供了革命性的解决方案。

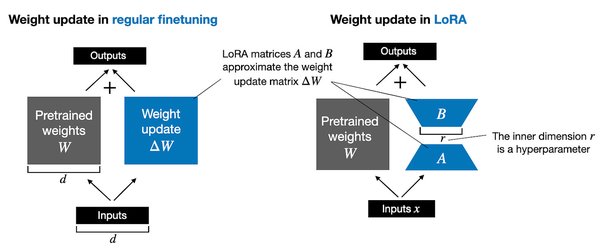

LoRA的原理

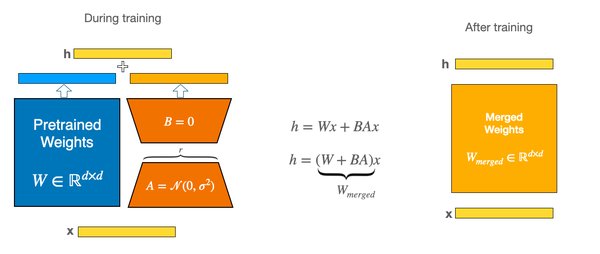

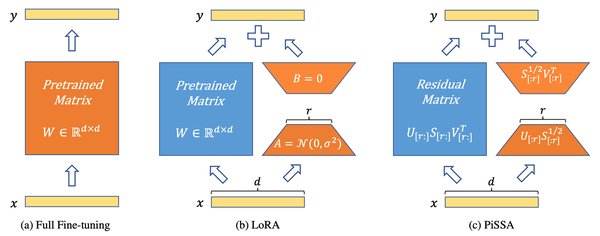

LoRA是一种低秩适应技术,通过引入低秩矩阵来调整大语言模型的参数,从而在保持模型性能的同时,显著降低计算成本。具体来说,LoRA通过在模型的权重矩阵中添加一个低秩矩阵,来实现对模型的微调。这种方法不仅减少了参数数量,还提高了微调效率。

低秩矩阵的优势

- 计算效率高:低秩矩阵的引入减少了计算复杂度,使得微调过程更加高效。

- 参数数量少:相较于传统微调方法,LoRA所需的参数数量大幅减少,降低了存储和计算资源的消耗。

- 性能稳定:实验表明,LoRA在多个任务上均能保持甚至提升模型的性能。

LoRA的应用场景

LoRA技术在大语言模型的微调中具有广泛的应用前景,以下是一些典型的应用场景:

1. 行业模型训练

在特定行业中,如金融、医疗、法律等,大语言模型需要针对行业特有的数据进行微调。LoRA技术能够快速适应这些数据,提升模型在行业任务中的表现。

2. 多语言支持

对于多语言任务,LoRA可以高效地调整模型以适应不同语言的特点,提升模型在多语言环境下的表现。

3. 个性化推荐

在个性化推荐系统中,LoRA可以根据用户的历史行为和偏好,快速调整模型,提供更加精准的推荐结果。

实际案例分析

以Manus为例,这款被誉为“全球首款真正意义上的通用AI Agent”的产品,其背后的技术团队BUTTERFLY EFFECT在开发过程中,采用了LoRA技术进行模型微调。这使得Manus在处理复杂任务时,能够快速适应不同场景,展现出卓越的性能。

Manus的成功经验

- 人力资源场景:Manus能够高效处理多份简历,精准记录重要信息,并提供专业的排名建议。

- 房产筛选:在纽约购房需求中,Manus能够有条不紊地拆解复杂任务,提供详细的购房参考报告。

- 股票分析:Manus通过API访问权威数据源,进行数据分析和可视化操作,甚至创建网站并提供分享链接。

未来展望

随着AI技术的不断发展,LoRA技术有望在更多领域实现深度应用。未来,LoRA将不仅在模型微调中发挥重要作用,还可能与其他AI技术结合,推动智能家居、工业物联网等领域的智能化转型。

技术优化与创新

- 提升自主学习能力:未来,LoRA技术将进一步提升模型的自主学习能力,使其能够更好地适应复杂任务。

- 与多领域融合:LoRA技术将与物联网、机器人技术等领域结合,催生更多创新应用。

结语

LoRA技术作为大语言模型微调的革命性方法,不仅降低了计算成本,还提升了模型性能。随着技术的不断迭代,LoRA将在更多领域实现深度应用,为全球用户带来更智能、便捷的生活和工作体验。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...