引言

DeepSeek-V3的发布不仅在技术上实现了突破,更在AI开发领域引发了深刻的变革。其创新的MoE(Mixture of Experts)架构和开源策略,正在挑战传统AI开发的固有模式,并为行业带来新的可能性。

MoE架构的技术优势

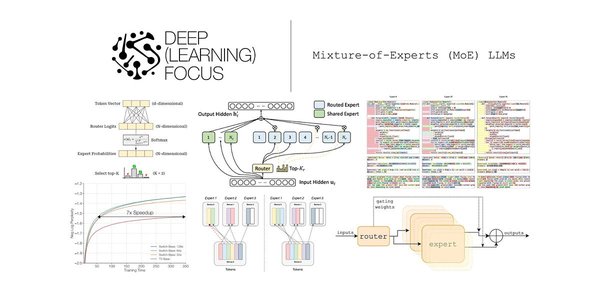

MoE架构是DeepSeek-V3的核心创新之一,它通过以下方式显著提升了模型的效率和性能:

- 参数优化:DeepSeek-V3拥有6710亿参数,但在推理过程中仅激活370亿参数,大幅降低了计算资源需求。

- 专家模型协作:MoE架构由256个小型专家模型组成,每个token仅激活8个专家模型,确保了高效的任务处理能力。

- 成本与速度提升:相比单一大模型,MoE架构的训练成本降低40%,生成速度提升80%。

DeepSeek-V3的低成本高性能特性

DeepSeek-V3在训练和推理效率上的表现令人瞩目:

| 特性 | DeepSeek-V3 | GPT-4o |

|---|---|---|

| 训练成本 | 557.6万美元 | 约1亿美元 |

| 推理效率 | 高效MoE架构 | 传统单一大模型 |

| 硬件需求 | 高性能PC | 专用服务器 |

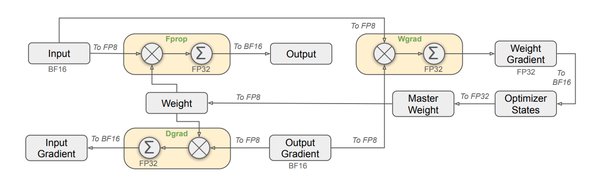

通过混合精度计算和GPU优化,DeepSeek-V3在有限资源下实现了卓越的性能。

开源策略对AI开发的影响

DeepSeek的开源策略不仅推动了技术的透明化,还为行业带来了以下深远影响:

- 技术民主化:开源模型使得更多企业和开发者能够低成本地接入高性能AI技术。

- 安全与隐私保障:企业可以在内部网络中部署模型,无需担心数据泄露风险。

- 行业竞争格局重塑:开源AI模型的出现,迫使传统闭源企业重新思考其商业模式。

未来展望

DeepSeek-V3的成功标志着AI开发进入了一个新的时代。未来,MoE架构和开源策略的结合,将进一步推动AI技术的普及和应用。企业需要积极拥抱这一趋势,探索AI在业务中的更多可能性。

结语

DeepSeek-V3的MoE架构和开源策略,不仅是技术上的突破,更是对AI开发模式的深刻变革。随着技术的不断演进,AI将在更多领域发挥其潜力,为人类社会带来深远影响。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...