引言

在当今的AI技术领域,Transformer模型及其核心组件——注意力机制,已经成为推动技术发展的关键力量。本文将深入探讨注意力机制的原理及其在AI技术中的应用,并探讨如何将这些技术应用于学习和时间管理,提升职场竞争力。

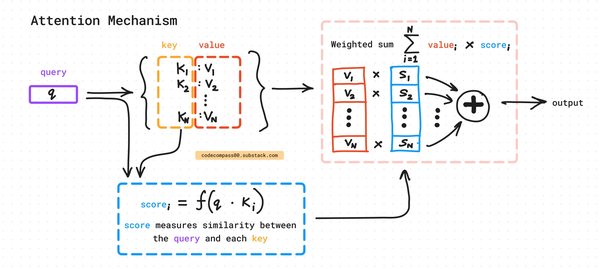

注意力机制的基本原理

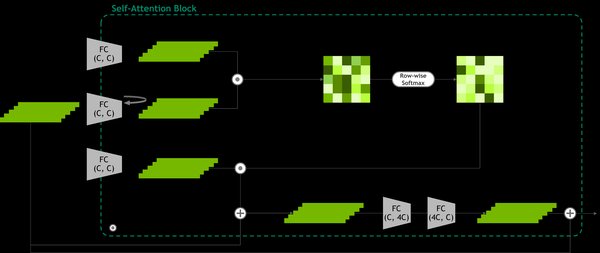

注意力机制是Transformer模型的核心,它通过计算输入序列中各个元素的重要性权重,来决定模型在处理任务时应该关注哪些部分。这种机制使得模型能够捕捉到长距离依赖关系,从而在处理复杂任务时表现出色。

注意力机制的关键组件

- 查询(Query):表示当前需要处理的信息。

- 键(Key):表示输入序列中的各个元素。

- 值(Value):表示与键对应的实际信息。

通过计算查询与键之间的相似度,模型可以确定每个值的重要性权重,从而进行加权求和,得到最终的输出。

AI技术在学习和时间管理中的应用

随着AI技术的普及,越来越多的学生和职场人士开始将其应用于学习和时间管理。以下是一些具体的应用场景:

学习中的应用

- 智能辅导系统:利用AI技术,根据学生的学习进度和掌握情况,提供个性化的学习建议和资源。

- 自动化笔记整理:通过自然语言处理技术,自动整理和分类学习笔记,提高学习效率。

时间管理中的应用

- 智能日程安排:根据个人的工作习惯和任务优先级,自动生成最优的日程安排。

- 任务提醒与追踪:通过AI技术,实时提醒任务的截止日期,并追踪任务的完成情况。

职场竞争力的提升

掌握AI技术不仅能够提升个人的学习和时间管理能力,还能在职场中提升竞争力。以下是一些具体的应用场景:

实习和科研中的应用

- 自动化数据分析:利用AI技术,快速处理和分析大量数据,提高科研效率。

- 智能报告生成:通过自然语言生成技术,自动生成科研报告,节省时间和精力。

本科阶段科研训练的重要性

本科阶段的科研训练是培养AI技术应用能力的重要途径。通过参与科研项目,学生可以深入理解AI技术的原理和应用,为未来的职业发展打下坚实的基础。

结论

Transformer模型中的注意力机制是AI技术发展的核心驱动力。通过深入理解其原理,并将其应用于学习和时间管理,我们可以有效提升个人的学习和工作效率,进而在职场中占据有利地位。本科阶段的科研训练则是培养这些能力的重要途径,为未来的职业发展奠定坚实的基础。

参考文献

- InfoQ的DeepSeek系列直播

- 关于Agent类型的技术讨论

- 新架构编译器和编程系统的技术探讨

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...