随着人工智能技术的飞速发展,大语言模型(LLMs)在各个领域的应用越来越广泛。然而,如何有效地微调这些模型以适应特定任务,成为了许多开发者和研究人员关注的焦点。本文将介绍两篇关于如何通过Hugging Face在2024年和2025年微调LLMs的文章,并提供相关课程的访问链接,帮助读者掌握最新的AI技术趋势和微调方法。

2024年LLMs微调课程

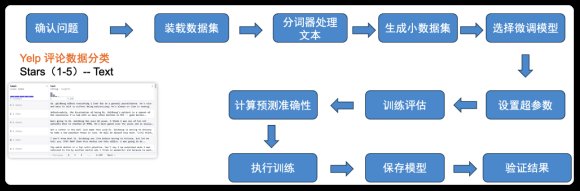

在2024年,Hugging Face推出了一系列针对LLMs微调的课程,涵盖了从基础到高级的各种技术。这些课程不仅介绍了微调的基本概念,还深入探讨了如何在不同场景下应用这些技术。例如,课程中详细讲解了如何使用Hugging Face的Transformers库进行模型微调,以及如何处理不同格式的文本数据。

关键知识点:

-

微调基础:了解微调的基本原理和步骤。

-

Transformers库:掌握如何使用Hugging Face的Transformers库进行模型微调。

-

文本处理:学习如何处理不同格式的文本数据,以提高模型的适应性。

2025年LLMs微调课程

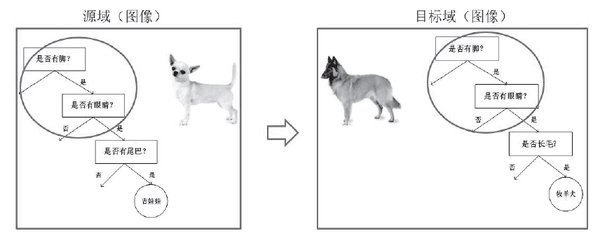

进入2025年,Hugging Face进一步扩展了其微调课程,加入了更多高级技术和应用场景。这些课程不仅关注模型的性能提升,还强调了模型的可解释性和安全性。例如,课程中介绍了如何使用迁移学习和多任务学习来提升模型的泛化能力,以及如何通过模型蒸馏来减小模型的大小和计算成本。

关键知识点:

-

迁移学习:掌握迁移学习在LLMs微调中的应用。

-

多任务学习:学习如何通过多任务学习提升模型的泛化能力。

-

模型蒸馏:了解模型蒸馏的原理和应用,以减小模型的大小和计算成本。

如何访问这些课程

要访问这些课程,读者可以前往Hugging Face的官方网站,注册并登录后即可浏览和参与相关课程。这些课程不仅提供了丰富的理论知识,还包含了大量的实践案例和代码示例,帮助读者更好地理解和应用LLMs微调技术。

结语

掌握LLMs微调技术是当前AI领域的重要趋势之一。通过Hugging Face提供的课程,读者可以系统地学习和掌握这些技术,从而在2024年和2025年的AI发展中占据先机。无论是初学者还是资深开发者,这些课程都将为你的AI之旅提供宝贵的资源和指导。