差分隐私的基本概念

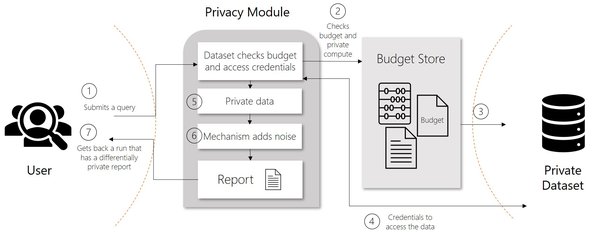

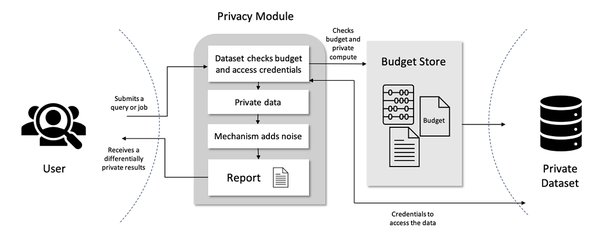

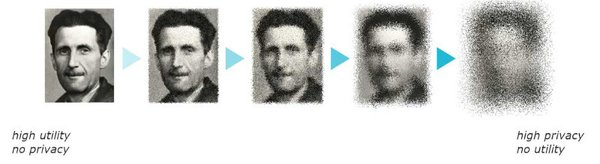

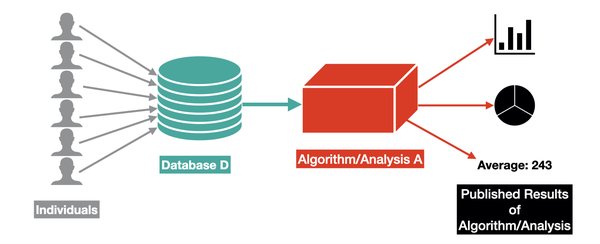

差分隐私(Differential Privacy,DP)是一种密码学手段,旨在提高统计数据库查询的准确性,同时最大限度地减少识别具体记录的机会。它通过添加噪声或扰动数据,确保查询者无法判断特定样本是否存在于数据集中。差分隐私分为集中式差分隐私(CDP)和本地差分隐私(LDP),分别适用于不同的应用场景。

-

集中式差分隐私(CDP):在数据集中添加噪声,适用于数据集中处理的场景。

-

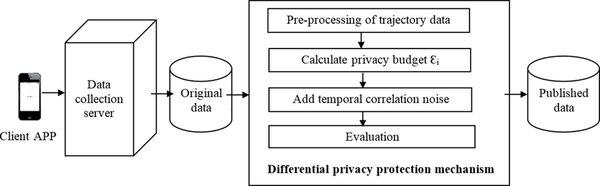

本地差分隐私(LDP):在数据收集阶段即对用户数据进行扰动,适用于分布式数据收集场景。

差分隐私的核心技术

差分隐私的实现依赖于多种机制,包括Laplace机制、Gaussian机制和指数机制。

-

Laplace机制:适用于数值型数据查询,通过添加符合拉普拉斯分布的噪声实现隐私保护。

-

Gaussian机制:在L2敏感度远低于L1敏感度的场景下,添加的噪声更小,适用于高维数据查询。

-

指数机制:用于从备选回复集合中选择最佳结果,同时满足差分隐私要求。

DeepSeek AI系统的隐私保护实践

DeepSeek AI系统通过创新的隐私计算架构,将差分隐私技术应用于数据全生命周期的保护,特别是在金融、医疗、政务等敏感领域。

-

数据输入防护:采用动态同态加密技术,结合256位SM9国密算法,确保数据在端侧设备即被加密处理。

-

训练数据脱敏:通过生成对抗网络创建合成数据集,移除敏感关联,同时保持数据分布特性。

-

模型推理隐私保护:集成可信执行环境(TEE),在硬件安全区完成敏感计算,确保推理过程的安全性。

差分隐私在机器学习中的应用

差分隐私在机器学习领域的应用日益广泛,特别是在联邦学习和模型训练中。

-

联邦学习:在模型更新阶段添加梯度噪声,防止模型反演攻击。

-

模型训练:通过语义混淆算法对文本数据进行扰动,确保原始语句重构错误率达73.5%。

未来展望

随着量子计算和光子神经网络技术的发展,差分隐私保护机制将迎来新的突破。DeepSeek AI系统正在测试量子隐私计算方案,利用量子纠缠态实现绝对安全的数据传输。预计到2026年,光子神经网络芯片的部署将彻底消除电子侧信道攻击风险。

结语

差分隐私保护机制为数据安全提供了强有力的技术支撑,DeepSeek AI系统的创新实践展示了其在各领域的广泛应用前景。未来,随着技术的不断演进,差分隐私将在数据保护中发挥更加重要的作用。