Mamba架构:序列建模的革命性突破

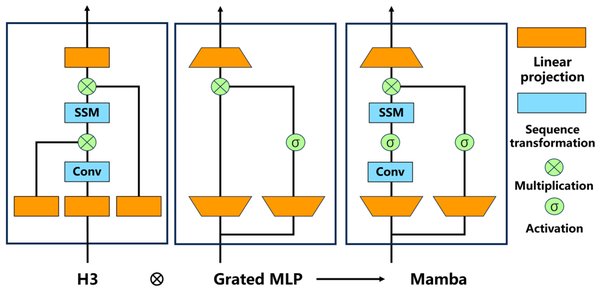

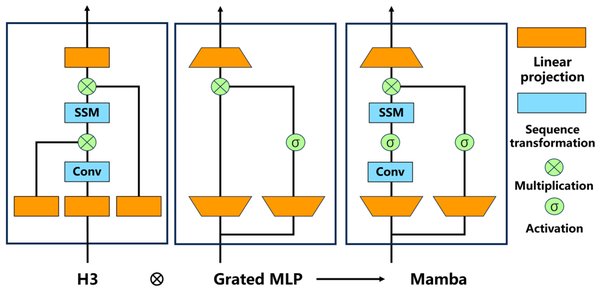

Mamba架构是一种基于选择式状态空间模型(SSM)的深度学习架构,旨在高效处理文本、时间序列、语音等序列数据。与传统Transformer和RNN相比,Mamba在序列建模中展现了独特的优势。

Mamba的核心改进

-

选择性扫描算法:Mamba通过选择性机制,能够动态过滤无关信息,保留关键上下文,从而提升模型的内容感知能力。

-

硬件感知型计算:Mamba采用并行扫描、核融合和重计算等技术,优化了GPU的存储与计算效率,显著降低了训练和推理成本。

-

记忆管理:通过创新的扫描模式和状态管理,Mamba实现了对长序列的高效处理,避免了Transformer中KV-Cache的平方级扩展问题。

Mamba的应用领域

-

自然语言处理:Mamba在文本生成、翻译等任务中表现出色,尤其适合处理长文档和复杂上下文。

-

计算机视觉:Mamba的高效序列处理能力使其在视频分析和时间序列预测中具有潜力。

-

语音分析:Mamba的硬件感知型计算使其在实时语音处理中表现优异。

腾讯混元Turbo S:Mamba架构的创新实践

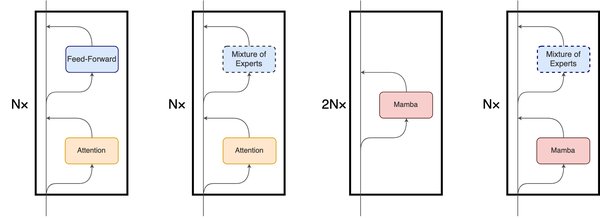

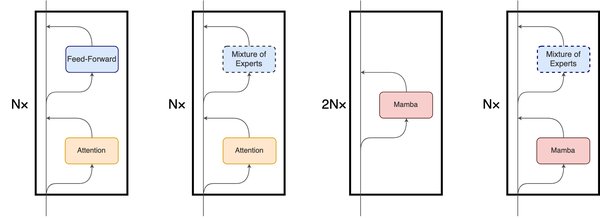

腾讯混元Turbo S是Mamba架构在工业界的首次成功应用,其创新性的Hybrid-Mamba-Transformer融合模式,标志着深度学习领域的新突破。

Hybrid-Mamba-Transformer的优势

-

高效长序列处理:Mamba架构使Turbo S能够在不产生过多计算开销的情况下处理更长的文本,适合阅读、总结和生成长文档的回答。

-

复杂上下文捕捉:Transformer架构保留了Turbo S在数学运算、逻辑推理和问题解决中的优势,使其在推理密集型任务中表现出色。

-

成本优化:通过降低KV-Cache缓存占用和计算复杂度,Turbo S显著减少了训练和推理成本,输入价格为0.8元/百万tokens,输出价格为2元/百万tokens,远低于前代模型。

Turbo S的性能表现

在业界通用的多个公开基准测试中,腾讯混元Turbo S在知识、数学、推理等多个领域展现出对标DeepSeek V3、GPT-4O、Claude3.5等业界领先模型的效果表现。

未来展望

Mamba架构与Hybrid-Mamba-Transformer融合模式的成功应用,为深度学习领域带来了新的可能性。随着技术的不断发展和创新,Mamba架构有望在更多领域实现应用落地,特别是在艺术、写作、教育等领域,推动AI技术的普及与应用,为社会带来更多机会与价值。

腾讯混元Turbo S的发布,不仅展示了Mamba架构的潜力,也为未来的AI产品开发提供了坚实的基础。随着AI技术的不断进步,我们期待看到更多基于Mamba架构的创新应用,为数字创作和智能化生活注入新的活力。