扩散模型的技术基础与发展

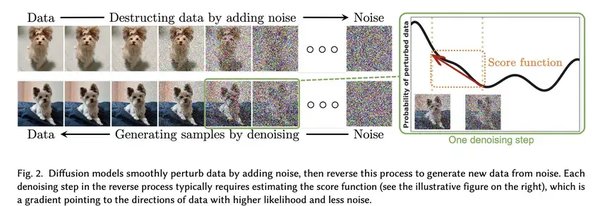

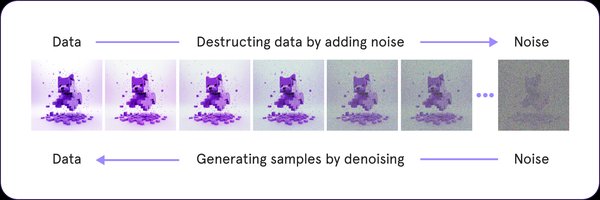

扩散模型(Diffusion Models)是近年来生成式AI领域的一大突破。与传统的卷积神经网络(CNN)不同,扩散模型通过模拟数据的扩散过程来生成高质量图像。自2010年以来,CNN一直是计算机视觉的主流技术,但扩散模型的出现为图像生成任务提供了新的可能性。例如,Stable Diffusion模型基于23亿张图像的预训练,能够根据文本输入生成逼真的图像。

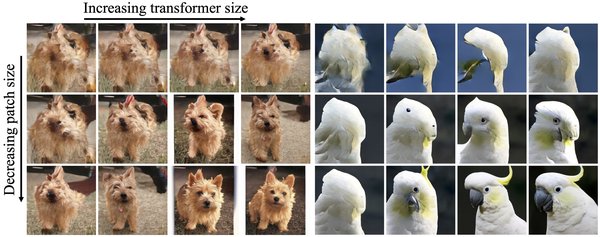

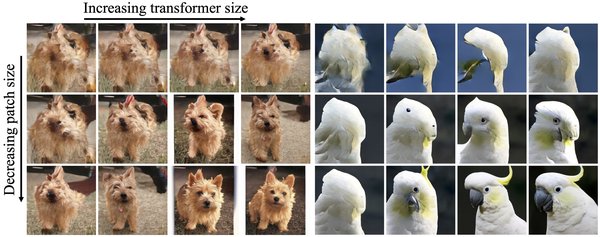

扩散模型与Transformer架构的融合

2017年,Transformer架构的提出彻底改变了自然语言处理(NLP)领域,并直接推动了大型语言模型(LLM)的发展。随后,研究人员开始将Transformer应用于计算机视觉任务,开创了视觉Transformer(ViT)等模型。这种融合不仅提高了模型的全局背景理解能力,还显著提升了图像识别的准确率。

扩散模型与Transformer的结合进一步拓展了生成式AI的应用范围。例如,OpenAI的CLIP模型结合了文本和图像输入,能够生成多模态输出。这种多模态能力使得扩散模型在工业应用中具有巨大的潜力,如自动驾驶、医疗影像分析等。

扩散模型在工业中的应用

扩散模型在工业中的应用已经开始显现。例如,SymphonyAI利用大型视觉模型(LVM)优化制造、安全和零售环境中的图像识别任务。通过微调预训练的LVM,企业能够快速实现价值,而无需从头训练模型。这种开箱即用的性能大大缩短了客户的价值实现时间。

此外,扩散模型在实时决策中的应用也面临挑战。由于其参数规模庞大,运行推理需要大量的计算资源。然而,随着硬件技术的进步,如FPGA等专用处理器的普及,这一限制有望得到缓解。

未来展望

扩散模型的崛起标志着生成式AI和计算机视觉领域的新篇章。随着技术的不断进步,扩散模型将在更多领域得到广泛应用,如医疗、自动驾驶、零售等。未来,我们可以期待看到更多基于扩散模型的创新应用,推动AI技术向更高层次发展。

扩散模型不仅为生成式AI提供了新的技术路径,还为计算机视觉领域带来了革命性的变化。随着研究的深入和应用的拓展,扩散模型有望成为未来AI发展的重要驱动力。