引言

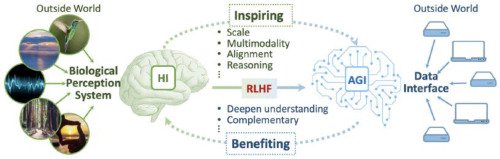

随着人工智能技术的飞速发展,多模态融合逐渐成为实现通用人工智能(AGI)的核心路径。多模态模型能够处理和理解文本、图像、音频、视频等多种形式的数据,为AI系统提供更全面、更丰富的感知与决策能力。本文将深入探讨多模态融合的技术演进、挑战与未来前景,并结合OpenAI、DeepSeek等前沿案例,分析其在智能体、AI搜索等领域的应用潜力。

多模态融合的技术演进

多模态融合的技术演进可以分为三个阶段:单模态→多模态→世界模型。

1. 单模态阶段

早期的人工智能技术主要集中在单一模态的发展,如自然语言处理、计算机视觉和语音识别等。这些技术虽然在某些特定任务上表现出色,但缺乏跨模态的协同能力。

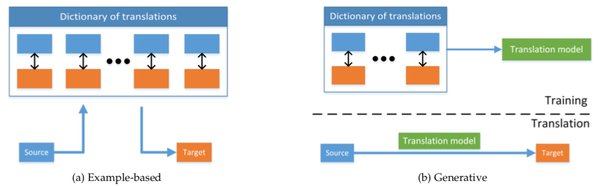

2. 多模态阶段

当前,AI技术正进入多模态融合阶段。例如,GPT-4V能够同时理解输入的文字与图像,Sora可以根据文字、图像与视频生成视频。然而,现阶段的多模态融合仍存在“理解”与“生成”任务分离的问题,导致模型在某些任务上的表现不够均衡。

3. 世界模型阶段

世界模型被认为是实现AGI的关键一步。与多模态模型不同,世界模型通过传感器直接感知外部环境信息,并输出时间序列数据(TSD),从而实现对物理世界的实时交互与决策。

多模态融合的挑战

尽管多模态融合展现出巨大潜力,但其发展仍面临多重挑战:

1. 数据质量与处理

数据是大模型的基石,但多模态数据的收集、清洗和标注成本高昂,且不同模态的数据可能存在分辨率、格式和质量上的不一致性。

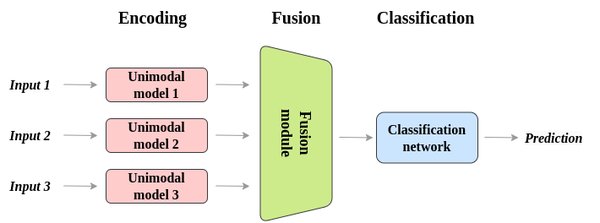

2. 模型设计与训练

多模态模型的训练过程更为复杂,需要更多的计算资源和调优工作。此外,如何平衡不同模态的信息贡献、避免模态间的信息冲突,也是设计中的难点。

3. 模态不一致与不平衡

某些模态的数据可能更丰富或更可靠,而其他模态的数据则可能稀疏或含噪声。如何处理这种不一致和不平衡,确保模型能够公平、有效地利用各模态的信息,是亟待解决的问题。

多模态融合的应用前景

多模态融合在智能体、AI搜索、AI终端应用等领域展现出广阔的应用前景。

1. 智能体

多模态模型能够为智能体提供更全面的感知与决策能力。例如,蘑菇车联的MogoMind大模型通过整合物理世界实时数据,实现了对城市交通的实时感知与决策反馈。

2. AI搜索

多模态融合可以提升AI搜索的精准度与效率。例如,狮腾控股与盟拓数字科技联合开发的Geene平台,通过智能动态路由技术,根据查询需求自动匹配最适合的AI模型,确保运算效能与精准度。

3. AI终端应用

多模态模型在智能座舱、高阶智驾等终端应用中也展现出巨大潜力。例如,阶跃星辰的Step系列多模态大模型已与吉利汽车星睿AI大模型深度融合,推动了AI技术在智能座舱领域的普及应用。

未来展望

多模态融合是通往AGI的必经之路,但其发展仍需克服数据质量、模型设计与模态不平衡等挑战。未来,随着技术的不断突破,多模态模型将在智能体、AI搜索、AI终端应用等领域发挥更大作用,推动人工智能技术的进一步发展与应用。

正如OpenAI CEO萨姆·奥特曼所言:“GPT模型是朝着AGI方向发展的重要突破。”而多模态融合,无疑将成为这一突破的核心驱动力。