引言

随着人工智能技术的快速发展,AI模型的推理效率成为了行业关注的焦点。测试时间缩放(Test-Time Scaling)作为一种新兴技术,正在改变AI模型的推理方式,尤其是在DeepSeek R1模型的推动下,这一技术的重要性愈发凸显。

测试时间缩放的定义与重要性

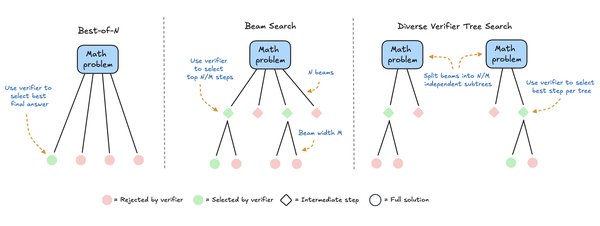

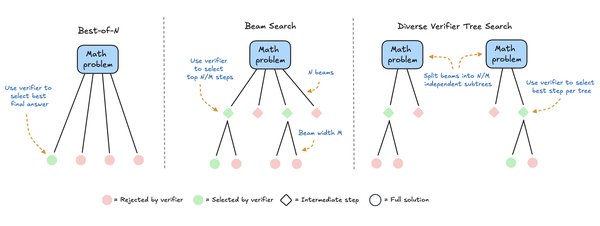

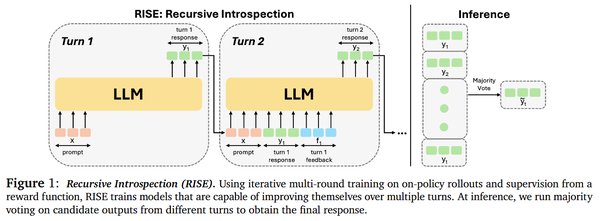

测试时间缩放是指在模型推理阶段,通过动态调整计算资源来提高推理效率的技术。与传统的静态推理方式不同,测试时间缩放能够根据输入数据的复杂性,灵活分配计算资源,从而在保证推理质量的同时,显著降低计算成本。

测试时间缩放的三个阶段

- 预训练阶段:模型在大规模数据集上进行初步训练,建立基础能力。

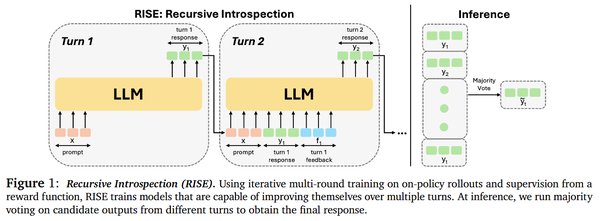

- 后训练阶段:通过强化学习、微调等技术,进一步优化模型性能。

- 测试时间缩放阶段:在推理阶段,动态调整计算资源,提高推理效率。

DeepSeek R1模型的突破

DeepSeek R1模型是测试时间缩放的绝佳范例。该模型不仅在预训练阶段表现出色,更在后训练和测试时间缩放阶段展现了强大的潜力。

推理效率的提升

DeepSeek R1模型通过高效的推理技术,每秒可处理3872个Token,显著提升了推理速度。这一突破不仅降低了推理成本,还为AI模型的广泛应用提供了可能。

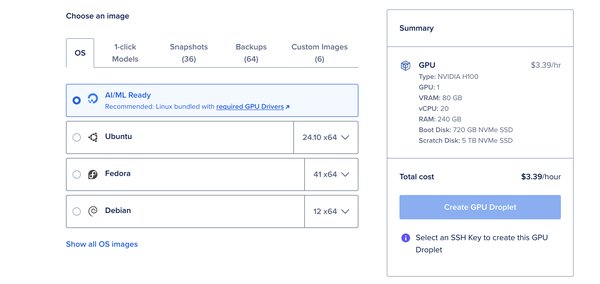

对GPU需求的影响

尽管DeepSeek R1模型在推理效率上取得了显著进展,但其后训练阶段仍需要大量的计算资源。黄仁勋指出,复杂问题的深度推理仍需高性能GPU支持,这进一步凸显了GPU在AI算力需求中的重要性。

AI算力需求的未来趋势

随着AI技术的不断进步,算力需求将持续增长。英伟达表示,未来的发展趋势将进一步增加算力需求,尤其是在企业用代理人工智能、机器人用物理人工智能等领域。

算力需求的增长

- 短期:近期采购订单和资本支出规模显示,算力需求保持强劲增长。

- 中期:基础设施水平和行业趋势的演变将进一步推动算力需求。

- 长期:AI技术的广泛应用将带来持续的算力需求增长。

结论

测试时间缩放作为AI模型推理效率的革命性突破,正在改变AI行业的发展格局。DeepSeek R1模型通过高效的推理技术,不仅提升了推理效率,还为AI模型的广泛应用提供了可能。未来,随着AI技术的不断进步,算力需求将持续增长,GPU在AI算力需求中的重要性也将愈发凸显。

通过本文的探讨,我们可以看到,测试时间缩放不仅是AI模型推理效率的关键技术,更是推动AI行业持续发展的重要动力。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...