Lora技术简介

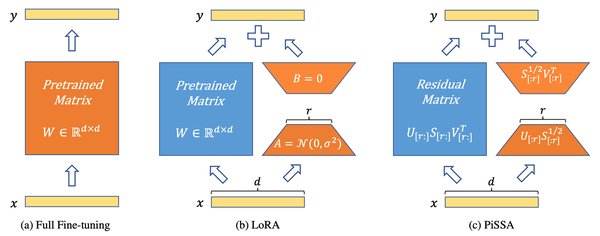

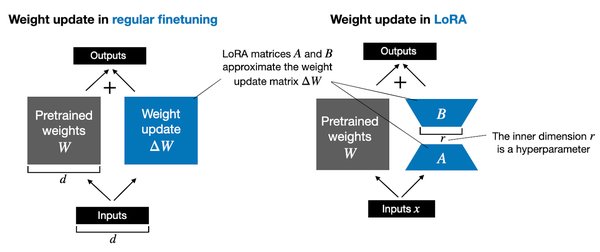

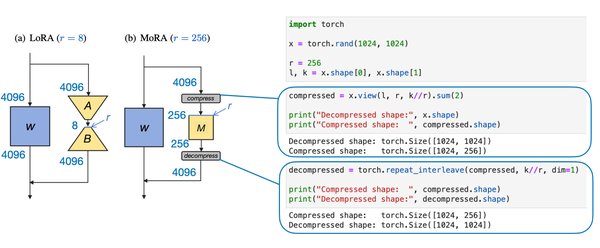

Lora(Low-Rank Adaptation)技术是一种用于大语言模型(LLM)高效微调的方法。通过低秩矩阵分解,Lora能够在保持模型性能的同时,显著减少参数数量和计算资源需求。这一技术在自然语言处理、金融科技等领域具有广泛的应用前景。

Lora技术在模型压缩中的应用

Lora技术在模型压缩中的应用主要体现在以下几个方面:

1. 结构化剪枝:通过Lora技术,可以对大语言模型进行结构化剪枝,减少模型规模,同时保持性能。

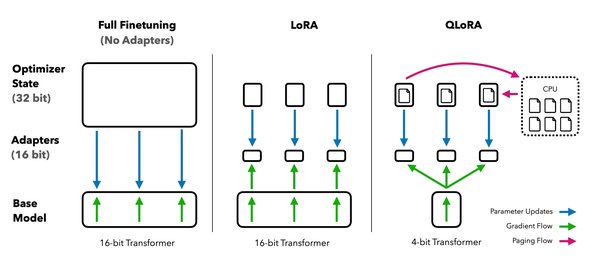

2. 混合精度量化:Lora技术结合混合精度量化策略,进一步降低内存消耗,提高模型效率。

九方智投的创新实践

九方智投公司在Lora技术上的创新实践主要体现在以下两个方面:

1. RankAdaptor:通过分层级别的秩分配方法,RankAdaptor实现了剪枝后LLM的高效微调,性能提升显著。

2. QPruner:结合结构化剪枝和混合精度量化,QPruner在节省内存的同时,保持了甚至提升了模型性能。

Lora技术的未来发展方向

Lora技术未来的发展方向主要包括:

1. 多模态交互:将Lora技术应用于多模态交互,提高模型在复杂场景下的适应能力。

2. 自动化微调:开发自动化微调工具,降低Lora技术的应用门槛,使其更易于推广。

3. 跨领域应用:探索Lora技术在医疗、教育等领域的应用,拓展其应用场景。

结论

Lora技术作为一种高效微调方法,在大语言模型中的应用前景广阔。九方智投公司在该技术上的创新实践,为金融科技领域的发展提供了新的思路。未来,随着技术的不断进步,Lora技术将在更多领域发挥重要作用。

| 技术名称 | 应用领域 | 主要特点 |

|---|---|---|

| RankAdaptor | 模型压缩 | 分层秩分配,高效微调 |

| QPruner | 模型压缩 | 结构化剪枝,混合精度量化 |

通过本文的介绍,读者可以深入了解Lora技术在大语言模型中的应用及其未来发展潜力。希望这一技术能够为更多领域带来创新和变革。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...