Transformer模型推动AI推理需求爆发

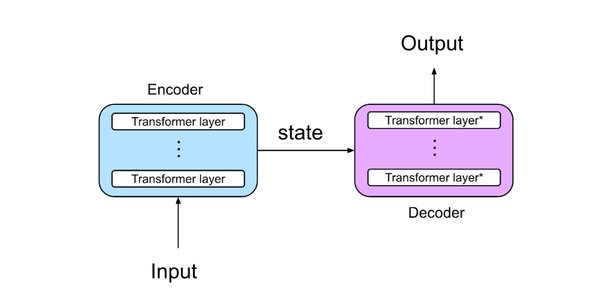

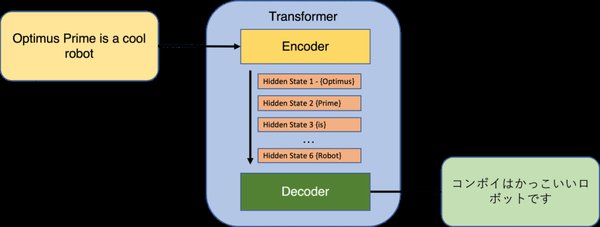

在2025财年第四季度财报电话会议上,英伟达CEO黄仁勋明确指出,AI推理带来的计算需求将远超当前的大语言模型(LLM),可能需要比现有计算能力高出数百万倍。这一预测与Transformer模型在AI领域的广泛应用密切相关。Transformer模型凭借其强大的并行计算能力和高效的注意力机制,已成为自然语言处理、计算机视觉等领域的核心技术。然而,随着模型规模的不断扩大,推理任务的复杂性和计算需求也在成倍增长。

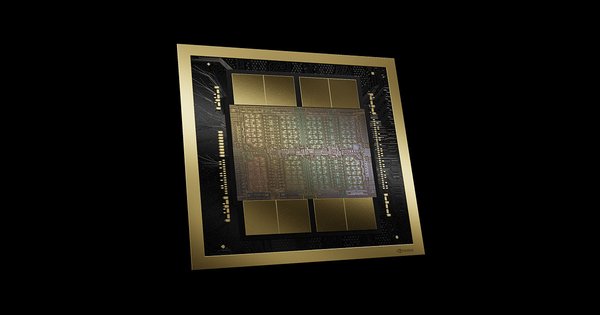

英伟达的应对策略:Blackwell系列芯片

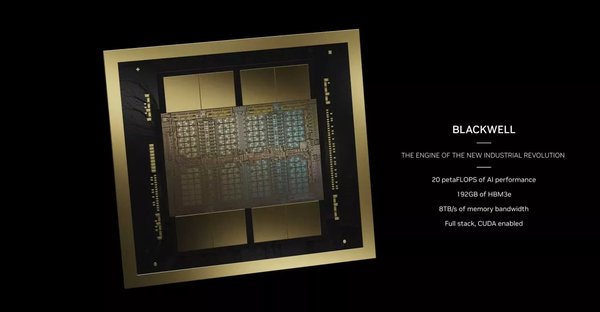

面对这一挑战,英伟达通过Blackwell系列芯片展现了自己的技术实力。黄仁勋在电话会上确认,Blackwell系列芯片的供应链问题已完全解决,供应问题不会影响下一代产品的研发。此外,Blackwell Ultra计划于2025年下半年发布,这将进一步提升英伟达在AI推理市场的竞争力。

Blackwell系列芯片的特点包括:

-

针对大规模AI集群的通信优化

-

硬件加速Transformer引擎,直接面向大语言模型

-

支持稀疏计算,降低大模型训练成本

这些特性使Blackwell系列芯片在AI推理任务中表现出色,能够满足未来数百万倍计算需求的要求。

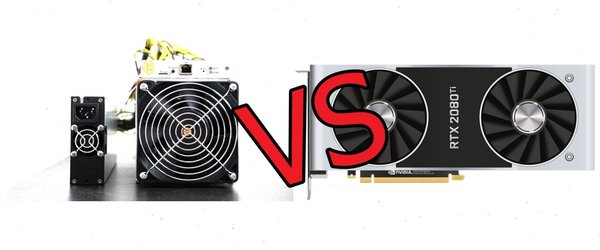

ASIC对GPU市场的潜在威胁

尽管英伟达在GPU市场占据主导地位,但ASIC(专用芯片)的崛起正在对其构成威胁。OpenAI、谷歌和亚马逊等公司纷纷开发自己的ASIC芯片,以减少对英伟达GPU的依赖。例如,谷歌的TPU在机器学习任务中表现出色,尤其在低延迟场景中具有优势。OpenAI也在开发自己的AI芯片,以减少对英伟达GPU的需求。

ASIC的优势包括:

-

硬件到软件全栈优化,避免通用计算冗余

-

成本效益更高,尤其在长期训练任务和批量推理中

-

低延迟场景中的性能更优

然而,ASIC也存在局限性,如绑定特定框架、无法修改硬件设计等。相比之下,英伟达的GPU支持更广泛的开源工具和私有化部署,且可通过架构升级和软件优化适应新需求。

英伟达的混合架构策略

为了应对ASIC的挑战,英伟达在Grace Hopper和Blackwell等AI加速器中采用了“通用+专用”的混合架构。这种策略既保留了GPU的通用性,又通过专用模块提升了关键场景的效率。例如,Tensor Core针对深度学习矩阵运算进行了优化,RT Core则专用于光线追踪加速。

这种混合架构的优势在于:

-

兼顾通用性和专用性,适应多样化的AI任务

-

通过专用模块提升关键场景的效率

-

支持灵活的架构升级和软件优化

未来展望

随着Transformer模型的广泛应用和AI推理需求的爆发,英伟达面临的挑战和机遇并存。通过Blackwell系列芯片和混合架构策略,英伟达正在巩固其在AI市场的领导地位。然而,ASIC的崛起也提醒我们,未来的AI硬件市场将更加多元化。英伟达能否继续保持领先地位,将取决于其技术创新和市场适应能力。

Transformer模型正在推动AI推理需求的爆发,而英伟达通过Blackwell系列芯片和混合架构策略,正在积极应对这一挑战。未来,AI硬件市场的竞争将更加激烈,英伟达的表现值得期待。