引言

随着人工智能技术的不断进步,多模态和跨模态学习已成为AI领域的重要发展方向之一。在NeurIPS 2024大会上,微软亚洲研究院的研究员们展示了多项创新成果,其中《EEG2Video:基于脑电信号解码动态视觉感知》论文引起了广泛关注。该论文探讨了如何从脑电信号(EEG)中解码动态视觉感知,提出了新的数据集SEED-DV和创新性解码框架EEG2Video,首次实现了从EEG信号解码并重建动态视频的目标。

EEG2Video技术的背景与意义

脑电信号(EEG)是一种高时间分辨率的神经成像技术,能够记录大脑活动。然而,传统研究大多聚焦于静态视觉刺激,缺乏对动态场景中快速变化视觉信息的数据集支持。动态视觉感知是人类日常生活体验的核心,其研究对揭示大脑视觉处理机制及提升脑机接口性能具有重要意义。

SEED-DV数据集

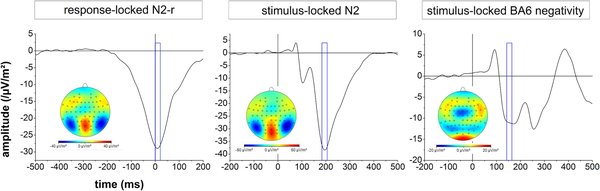

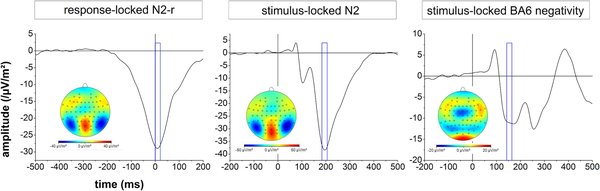

为了填补这一空白,研究员们首先收集了全新数据集SEED-DV,这是一个专为动态视觉解码设计的EEG-视频配对数据集。该数据集包含20名受试者的1400段视频EEG信号,涵盖40个概念的视频内容,同时详细标注了颜色、动态性、人物及场景等多种元信息。这一数据集为研究EEG解码动态视觉感知提供了坚实的基础,并提出了两个重要的基准测试——EEG视觉感知分类基准和视频重建基准,系统评估从EEG信号中解码视觉信息的能力和重建动态视频的性能。

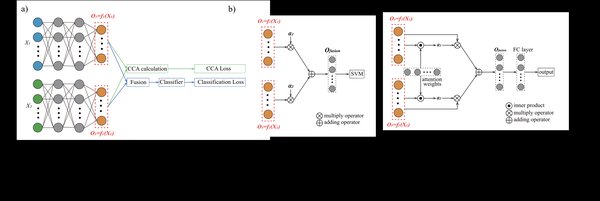

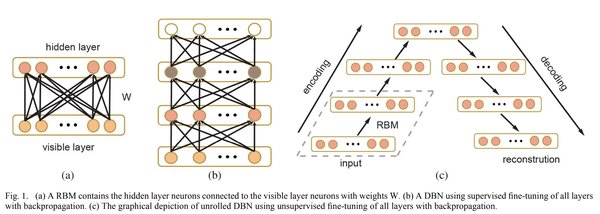

EEG2Video解码框架

基于SEED-DV数据集,研究员们提出了创新性解码框架EEG2Video,首次实现了从EEG信号解码并重建动态视频的目标。EEG2Video框架基于Seq2Seq架构,充分利用EEG信号的高时间分辨率,通过滑动窗口提取EEG嵌入,将视觉信息对齐至视频帧。同时,该框架还引入了动态感知噪声添加(DANA)模块,可根据解码的动态信息调整视频生成过程,使视频在物体动态的重建中也能保持一致性。

实验结果与应用前景

实验结果表明,EEG2Video生成的视频在结构相似性指数(SSIM)上达到了较高水平,并显著减少了解码步骤,解码效率远超传统方法。此外,基准测试结果显示,EEG信号中的关键视觉信息,如颜色和动态性,可被成功解码,而人物数量和人脸识别等任务仍具有挑战性。这一技术在多模态学习领域具有广泛的应用前景,特别是在脑机接口、虚拟现实和增强现实等领域。

结论

EEG2Video技术的突破为动态视觉感知的研究提供了新的视角和工具。通过SEED-DV数据集和创新性解码框架EEG2Video,研究员们首次实现了从脑电信号解码并重建动态视频的目标,为多模态学习领域的发展提供了重要支持。未来,随着技术的进一步优化和应用场景的拓展,EEG2Video有望在更多领域发挥其独特优势,推动人工智能技术的进步。