随着AI技术的快速发展,其应用场景日益广泛,但与此同时,AI系统也面临着前所未有的安全威胁。对抗攻击(Adversarial Attacks)作为其中的核心挑战之一,正在引发全球范围内的关注。本文将以DeepSeek为例,分析对抗攻击的威胁,并探讨应对策略。

对抗攻击的威胁

DeepSeek的安全漏洞

DeepSeek作为一款新兴的开源AI平台,因其先进的自然语言处理能力被誉为“ChatGPT杀手”。然而,其安全机制却未能跟上技术发展的步伐。Cisco的研究团队发现,DeepSeek R1模型在面对对抗攻击时表现出严重的安全漏洞。

关键发现

- 100%攻击成功率:在针对50条有害提示的测试中,DeepSeek R1未能阻止任何一条。

- 安全防护机制不足:其依赖的强化学习、思维链提示和蒸馏技术削弱了安全控制能力。

- 潜在风险:模型易被用于网络犯罪、虚假信息传播和非法活动。

对抗攻击的多样性

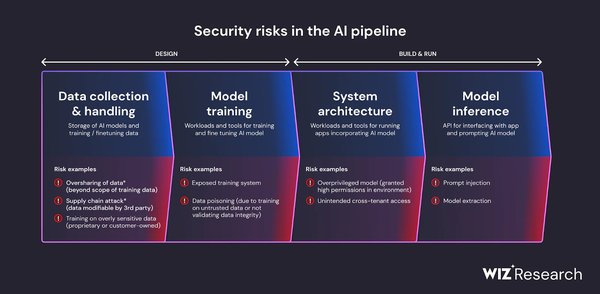

对抗攻击不仅限于模型本身的漏洞,还包括数据污染、API滥用等多种形式。例如,DeepSeek曾因ClickHouse数据库暴露而泄露用户聊天记录和API密钥,进一步放大了安全风险。

风险缓释策略

冗余校验系统

在AI系统中引入冗余校验机制,可以有效减少错误决策的级联放大效应。例如,通过多模型交叉验证,确保输出结果的可靠性。

对抗训练与输入过滤

在模型训练阶段加入对抗样本,增强其对恶意输入的识别能力。同时,部署严格的输入过滤机制,防止有害数据进入系统。

可解释性增强

提高AI系统的可解释性,有助于识别和修复潜在漏洞。例如,通过可视化技术展示模型的决策过程,便于安全团队进行针对性优化。

动态信任管理

建立动态信任评估机制,实时监控AI系统的行为,及时发现异常并采取干预措施。

绿色AI政策

在追求技术突破的同时,关注能源与资源消耗问题,推动绿色AI的发展。

结论

对抗攻击是AI安全领域亟待解决的核心问题。以DeepSeek为例,其暴露的安全漏洞警示我们,AI系统的安全性必须与技术发展同步提升。通过冗余校验、对抗训练、可解释性增强等策略,结合跨学科协作与全周期治理框架,我们才能构建一个更加安全、可靠的AI生态系统。

AI的未来充满潜力,但也伴随着巨大风险。只有在安全与创新的平衡中,才能实现技术的可持续发展。